Склонность к подтверждению – это когнитивное искажение, когда человек воспринимает, интерпретирует и запоминает информацию, подтверждающую исключительно его убеждения. Подобная тенденция широко распространена во многих сферах жизни, оказывает влияние на то, как люди принимают решения и формируют свои убеждения. Она даже способствует развитию различных проблемных моделей мышления. Например, когда в диалоге наш собеседник отказывается нас слушать и игнорирует факты, противоречащие его точке зрения.

Существует четыре основных области восприятия, где склонность к подтверждению влияет на людей:

- Предвзятый поиск. Поиск информации, которая подкрепляет прежнее мнение, и игнорирование информации, ей противоречащей.

- Предвзятое одобрение. Склонность придавать больший вес сведеньям, поддерживающим убеждения.

- Предвзятая интерпретация. Мы интерпретируем информацию тем способом, который подтверждает нашу точку зрения.

- Предвзятый отклик. Мы запоминаем то, что поддерживает наши убеждения, и забываем то, что им противоречит.

Приведем несколько примеров данного эффекта:

- Политика. Человек, обычно, предпочитает тратить больше времени на просмотр новостей, которые поддерживают его политическую позицию, игнорируя противоположную ей

- Наука. Склонность к подтверждению влияет на проведение научных исследований. Ученые часто демонстрируют предвзятость при проведении исследований, когда выборочно анализируют данные таким образом, который позволяет им подтвердить свои гипотезы

- Убеждения. Эффект влияет на то, как люди оценивают свои псевдонаучные убеждения. Например, человек, верящий в лженаучные теории, склонен к отрицанию опровержений этих теорий

- Инвестирование. Например, решения инвесторов, основанные на сведеньях, подкрепляющих их знания в отношении стоимости определенных акций

- Медицина. Врачи нередко выборочно ищут информацию, которая позволит им подтвердить свой первоначальный диагноз, игнорируя при этом признаки того, что этот диагноз может быть неверным

В целом, этот эффект влияет на людей по-разному и во многих сферах жизни. Разнообразные примеры демонстрируют, насколько распространено это когнитивное искажение и что оно может повлиять на любого.

Почему мы испытываем склонность к подтверждению

Существуют два основных когнитивных механизма, которые используются для объяснения того, почему люди испытывают склонность к подтверждению:

- Избегание проблем – человек не хочет знать, что он не прав.

- Поиск подкрепления – человек хочет знать, что он прав.

Оба эти фактора связаны с желанием свести к минимуму наш когнитивный диссонанс – психологический стресс, возникающий, когда мы придерживаемся двух или более противоречивых убеждений одновременно. Например, избегание проблем помогает справиться с когнитивным диссонансом, игнорируя сведения, не совпадающие с нашими убеждениями.

С другой стороны, поиск подкрепления побуждает нас найти поддержку своей первоначальной позиции, при столкновении с противоречиями. По сути, пытаясь дать объяснение каким-либо явлениям, мы стремимся сосредоточиться только на одной гипотезе, и игнорируем любые альтернативные суждения. Это приводит к попытке просто доказать, что первоначальная мысль верна, вместо того чтобы фактически проверить.

Например, врач, который ставит первоначальный диагноз пациенту, в попытке доказать, что он прав, отметает другие варианты как бессмысленные. Вот почему мы испытываем немотивированную склонность к подтверждению в ситуациях, когда нет эмоциональной причины отдавать предпочтение определенным предположениям.

Однако это контрастирует с мотивированной склонностью к подтверждению – когда мы подвергаемся воздействию этого эффекта под влиянием эмоционального восприятия. Наш мозг подавляет нервную деятельность в областях, связанных с чувственной регуляцией и эмоционально нейтральными рассуждениями, что приводит к обработке информации с основой на чувства, а не на логику.

Как уменьшить предвзятость подтверждения

Приведем примеры нескольких методов, которые можно использовать, чтобы уменьшить действие данного эффекта у окружающих:

- Стимулируйте людей избегать формирований предположений слишком рано. Поощряйте попытки обрабатывать как можно больше сведений, прежде чем формулировать первую мысль.

- Намекайте на различные причины того, почему мысль собеседника может быть неверной или почему альтернативные гипотезы могут быть верными. По сути, подобная просьба настраивает человека более охотно усваивать противоречащую его точке зрения информацию.

- Поощряйте собеседника быть активным участником процесса рассуждений и полагаться на сознательную и эмоционально нейтральную обработку информации, а не на интуицию.

Но как же уменьшить собственную склонность к подтверждению? Здесь способы очень схожи с методами, описываемыми выше. Первый и самый важный шаг к преодолению собственной предвзятости подтверждения состоит в осознании своего процесса рассуждения.

Рассуждая, нужно постоянно спрашивать себя: «Не искажаю ли я восприятие сведений, пытаясь подтвердить свои убеждения?» Следует избегать преждевременной формулировки предположений и заставлять себя искать причины, по которым ваша первоначальная гипотеза может быть неверной.

Подобная работа над собой, помимо помощи в преодолении предвзятости подтверждения, имеет еще одно важное дополнительное преимущество: вы лучше начинаете понимать противоположную точку зрения. А это в свою очередь имеет решающее значение для способности отстаивать свою собственную позицию и конструктивно общаться на различные темы с окружающими, что в наше время – достаточно большая редкость.

Так что советуем вам более осознанно относиться не только к тому, что вы думаете, но и к тому, как именно вы это делаете и почему. Уверяем вас, такой подход позволит вам избежать огромного количества неприятностей и добиться в жизни намного лучших результатов!

Искажение подтверждения: объясняем на «Геликах»

Кратко и с картинками про confirmation bias

Это одна из статей в поддержку курса «Яндекс Практикума» про критическое мышление. Они нам заплатили за разбор этой темы, но не влияют на содержание статьи, поэтому дальше будет наша кинжальная статья, а в конце — реклама курса. Статьи касаются основных когнитивных искажений и поиска истины, чисто наша с вами тема.

Критическое мышление — это когда вы мыслите самостоятельно и на основании фактов, не доверяя авторитетам просто потому, что они авторитеты. Следовательно, вы приходите к самостоятельным выводам и принимаете лучшие для себя решения. А всем, кто хочет навязать вам свои решения, от этого плохо.

Когнитивные искажения — это несовершенства нашего ума, которые мешают нам мыслить здраво и подталкивают к неверным выводам. Их огромная гора, сейчас поговорим об одном из жирных и распространённых.

Исходная ситуация

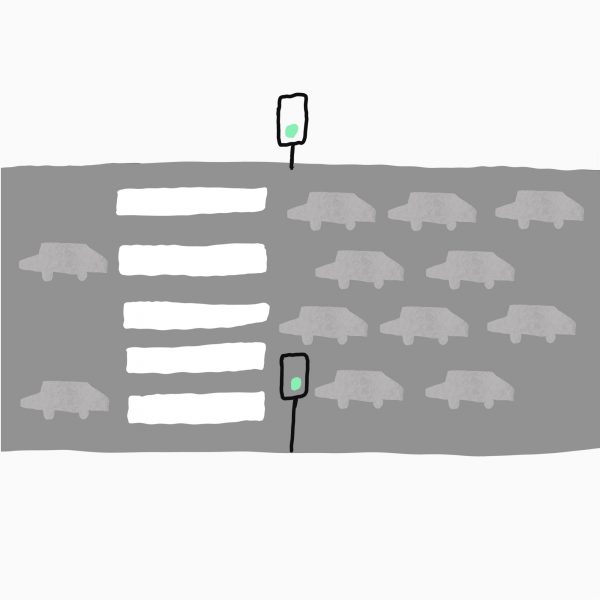

Допустим, вы живёте в большом городе и обычно ходите пешком. Пока вы идёте, мимо вас по улице проезжает поток машин. За день, допустим, это примерно 10 тысяч машин.

Пока вы не интересуетесь машинами, для вас это просто какой-то фоновый шум. Не задавила — и ладно. Вам красный — стоите и ждёте. Вам зелёный — проверяете, что никто не прёт на скорости и аккуратно переходите дорогу. Кто именно не прёт — «Мерс», «Лексус», «Лендровер» или «Лада седан», — вам с точки зрения пешехода не важно.

Это стандартное состояние ума: вы обращаете внимание на реальность лишь в той степени, в которой она непосредственно на нас влияет. Всё остальное вам не важно.

Когнитивная доминанта

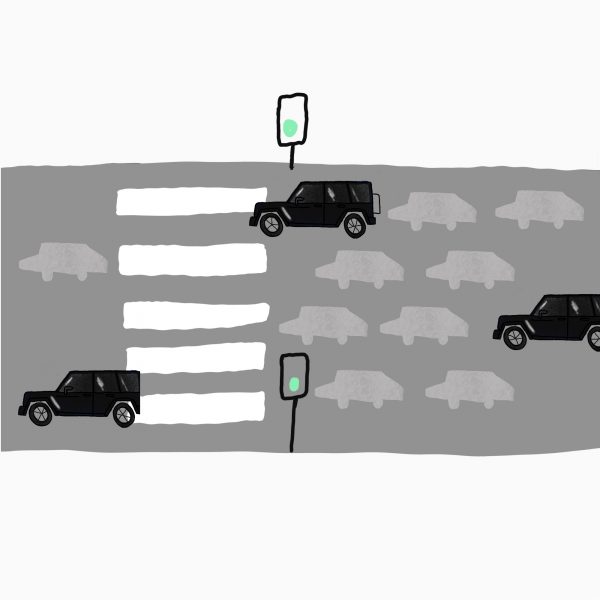

Теперь, допустим, вы решили получить права и занимаетесь в автошколе. Вы начинаете понемногу проникать в мир автомобилей, смотрите видеоролики в Ютубе и присматриваете себе машину. Среди друзей у вас находится заядлый автомобилист. Вы как-то вечером пьёте чай, и он вам говорит:

- Мерседес типа «Гелендваген» — это машины братков. Раньше это был армейский внедорожник, а теперь их коллекционируют братки из девяностых. Машина — ведро, но если видишь такую на улице, лучше держаться подальше — может выйти и расстрелять.

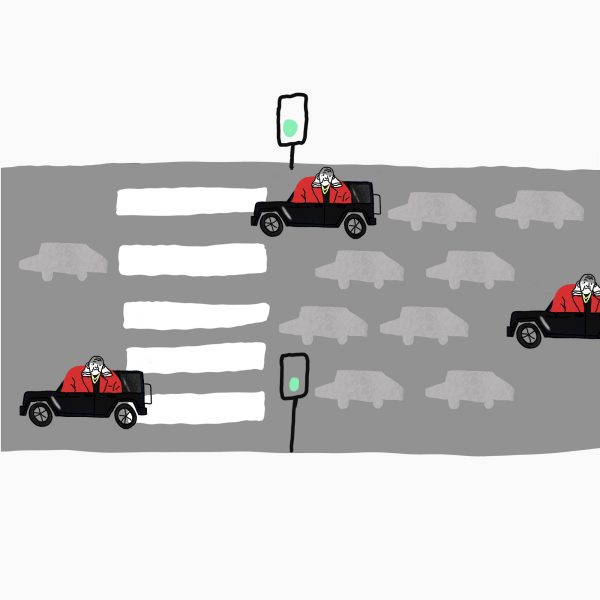

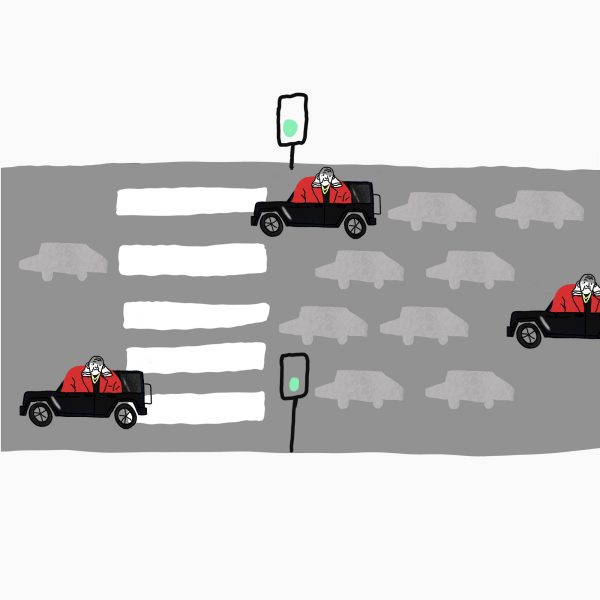

Теперь вы идёте по улице и, во-первых, начинаете замечать «Гелики»:

Во-вторых, теперь вы смотрите на водителя: «Ну точно, бандюган! Харя жирная, лицо злое, на зеркале чётки. Наверняка под сиденьем калаш».

Вы начинаете видеть много таких «Геликов» и обращаете внимание на потные злые лица их хозяев. И делаете вывод, что действительно «Гелик» — это бандитская машина.

Это и есть искажение подтверждения: вам задали некую доминанту, вы нашли ей подтверждение в реальности. А подтверждения обратного не искали.

Давайте по кусочкам:

- Вы приняли на веру тезис о бандитском характере автомобиля. У вас не было об этом данных, просто мнение одного человека.

- Вы увидели нечто, что вам показалось подтверждением этого тезиса (в частности, судили о людях по внешности, хотя у человека может быть диабет). Так могло повториться несколько раз.

- Вы согласились с этим тезисом, сделали его «своим». Теперь вы уверены, что «Гелик» бандитский, потому что увидели это своими глазами.

Критический подход

Если бы в этой ситуации мы применили критическое мышление, это бы выглядело так:

- Мы бы достали базу владельцев «Геликов» с 1990 года — новых или с пробегом. Отфильтровать тех, кто купил машину, но не ездит на ней.

- Мы бы достали базу людей, которых можно считать бандитами, — осуждённых за бандитизм и другие преступления. Также нужны были бы данные по связанным лицам — партнёрам, друзьям, членам семьи. По всем этим людям пробиваем их машины — так мы узнаем, на чём реально ездят бандиты.

- Наконец, с помощью компьютерного анализа мы бы сопоставили пересечения такого вида:

Предположительно мы бы пришли к выводу, что «Гелендваген» — это просто дорогой автомобиль, который покупают обеспеченные люди, не обязательно связанные с криминалом. Также, располагая нужными данными, мы бы могли прийти к таким выводам (например):

- Обеспеченные люди часто работают на более стрессовой работе, что связано с ожирением и диабетом.

- Аудитория «Гелендвагенов» молодеет, средний возраст владельца — 20 лет, эти люди в буквальном смысле не застали девяностые.

- Самый большой сегмент владельцев «Геликов» — публичные люди. Самая популярная опция у них — бронированное стекло и кузов. На «Гелике» катается не условный Боря Лютый, а условная Билли Айлиш.

- Женщин на «Геликах» больше, чем мужчин.

- Самая популярная машина среди бандитов — это та же машина, которая популярна в целом по городу.

Это как пример того, что мы могли бы накопать, подключив данные и критическое мышление. Но делать так никто не будет, потому что в практическом смысле нам эти выводы ни за чем не нужны.

⚠️ Это важный нюанс критического мышления: по-настоящему разбираться в предмете очень дорого и сложно. Поэтому применять эти навыки мы будем только там, где от этого что-то зависит. В остальных случаях мы будем в какой-то степени подвержены когнитивным искажениям, ничего тут не поделаешь.

Искажение подтверждения в жизни

Вот столбиком случаи, когда нас может искажать в сторону подтверждения существующей позиции. Просто как примеры:

- Уверены, что шаурма у вокзала невкусная. Подтверждение — у палатки как-то раз стоял неблагополучного вида мужчина. Искажение в том, что вид мужчины у палатки не связан со вкусом шаурмы.

- Думаем, что журналисты какого-то издания — некомпетентные. Подтверждение — одна из сотни статей, где они опубликовали интервью с несуществующим человеком. Искажение в том, что во всех изданиях допускают ошибки, а не только в этом одном.

- Думаем, что в России плохие дороги, ужасная инфраструктура, все всё разворовали. Подтверждение — плохая дорога у дома, покосившаяся мусорка, новости о посадках коррупционных чиновников.

- Думаем, что Россия — великая страна с прекрасными дорогами, сильной промышленностью и яростной борьбой с коррупцией. Подтверждение — платная трасса из Москвы в Питер, множество заводов по всей стране, новости о посадках коррупционных чиновников.

- Предполагаем, что современная молодёжь — инфантильные снежинки, способные только на нытьё. Подтверждение — треды с нытьём в Твиттере.

- Уверены, что современная молодёжь классная, бодрая и умная. Подтверждение — посещение олимпиады по программированию, например.

- Когда идёт война, принимаем какую-то сторону, подписываемся на соответствующие каналы и находим подтверждение своей позиции. А позицию другой стороны считаем вражеской пропагандой и одурманиванием населения.

Где правда?

И теперь самый острый философский вопрос: если под действием этого искажения мы можем найти подтверждение чему угодно, где же правда? Как на самом деле?

Это очень большой и сложный вопрос, о котором мы порассуждаем в следующий раз, потому что там нужно внимательно всё обмозговать. Пока что подпишитесь на нас там, где вам удобно: в VK или Телеграме. И прочитайте рекламное сообщение, если критическое мышление — ваша тема.

Peклaмнoe сообщение

У «Яндекс Практикума» есть курс «Критическое мышление». Это двухмесячный курс в смешанном формате: теория онлайн плюс практические воркшопы в формате вебинаров.

Основные темы курса:

- Особенности работы мозга, которые мешают принимать правильные решения. Когнитивные искажения, например ошибки в определении причин и следствий. Базовые принципы логики: индукция, дедукция, расчёт вероятностей. Правила анализа и составления аргументов.

- Работа с информацией. Вы научитесь не обманываться при определении проблемы. Распознавать, если кто-то манипулирует фактами или неправильно интерпретирует данные. Улучшать и оценивать ваши идеи, превращая их в эффективные решения.

- Воркшопы для отработки теории. Всю теорию вы будете закреплять на практических онлайн-воркшопах. Это будет командная работа, чтобы вы научились грамотно обосновывать свою точку зрения, выдвигая убедительные аргументы, и противостоять риторическим уловкам.

В курсе есть обратная связь и командная работа. Вводная часть бесплатно, а если «зайдёт» — то за деньги. Есть рассрочка.

Программа на 56 часов, 20 воркшопов плюс поддержка наставника.

Ссылка для читателей «Кинжала»: practicum.yandex.ru

Склонность к подтверждению – это когнитивное искажение, когда человек воспринимает, интерпретирует и запоминает информацию, подтверждающую исключительно его убеждения. Подобная тенденция широко распространена во многих сферах жизни, оказывает влияние на то, как люди принимают решения и формируют свои убеждения. Она даже способствует развитию различных проблемных моделей мышления. Например, когда в диалоге наш собеседник отказывается нас слушать и игнорирует факты, противоречащие его точке зрения.

Существует четыре основных области восприятия, где склонность к подтверждению влияет на людей:

- Предвзятый поиск. Поиск информации, которая подкрепляет прежнее мнение, и игнорирование информации, ей противоречащей.

- Предвзятое одобрение. Склонность придавать больший вес сведеньям, поддерживающим убеждения.

- Предвзятая интерпретация. Мы интерпретируем информацию тем способом, который подтверждает нашу точку зрения.

- Предвзятый отклик. Мы запоминаем то, что поддерживает наши убеждения, и забываем то, что им противоречит.

Приведем несколько примеров данного эффекта:

- Политика. Человек, обычно, предпочитает тратить больше времени на просмотр новостей, которые поддерживают его политическую позицию, игнорируя противоположную ей

- Наука. Склонность к подтверждению влияет на проведение научных исследований. Ученые часто демонстрируют предвзятость при проведении исследований, когда выборочно анализируют данные таким образом, который позволяет им подтвердить свои гипотезы

- Убеждения. Эффект влияет на то, как люди оценивают свои псевдонаучные убеждения. Например, человек, верящий в лженаучные теории, склонен к отрицанию опровержений этих теорий

- Инвестирование. Например, решения инвесторов, основанные на сведеньях, подкрепляющих их знания в отношении стоимости определенных акций

- Медицина. Врачи нередко выборочно ищут информацию, которая позволит им подтвердить свой первоначальный диагноз, игнорируя при этом признаки того, что этот диагноз может быть неверным

В целом, этот эффект влияет на людей по-разному и во многих сферах жизни. Разнообразные примеры демонстрируют, насколько распространено это когнитивное искажение и что оно может повлиять на любого.

Почему мы испытываем склонность к подтверждению

Существуют два основных когнитивных механизма, которые используются для объяснения того, почему люди испытывают склонность к подтверждению:

- Избегание проблем – человек не хочет знать, что он не прав.

- Поиск подкрепления – человек хочет знать, что он прав.

Оба эти фактора связаны с желанием свести к минимуму наш когнитивный диссонанс – психологический стресс, возникающий, когда мы придерживаемся двух или более противоречивых убеждений одновременно. Например, избегание проблем помогает справиться с когнитивным диссонансом, игнорируя сведения, не совпадающие с нашими убеждениями.

С другой стороны, поиск подкрепления побуждает нас найти поддержку своей первоначальной позиции, при столкновении с противоречиями. По сути, пытаясь дать объяснение каким-либо явлениям, мы стремимся сосредоточиться только на одной гипотезе, и игнорируем любые альтернативные суждения. Это приводит к попытке просто доказать, что первоначальная мысль верна, вместо того чтобы фактически проверить.

Например, врач, который ставит первоначальный диагноз пациенту, в попытке доказать, что он прав, отметает другие варианты как бессмысленные. Вот почему мы испытываем немотивированную склонность к подтверждению в ситуациях, когда нет эмоциональной причины отдавать предпочтение определенным предположениям.

Однако это контрастирует с мотивированной склонностью к подтверждению – когда мы подвергаемся воздействию этого эффекта под влиянием эмоционального восприятия. Наш мозг подавляет нервную деятельность в областях, связанных с чувственной регуляцией и эмоционально нейтральными рассуждениями, что приводит к обработке информации с основой на чувства, а не на логику.

Как уменьшить предвзятость подтверждения

Приведем примеры нескольких методов, которые можно использовать, чтобы уменьшить действие данного эффекта у окружающих:

- Стимулируйте людей избегать формирований предположений слишком рано. Поощряйте попытки обрабатывать как можно больше сведений, прежде чем формулировать первую мысль.

- Намекайте на различные причины того, почему мысль собеседника может быть неверной или почему альтернативные гипотезы могут быть верными. По сути, подобная просьба настраивает человека более охотно усваивать противоречащую его точке зрения информацию.

- Поощряйте собеседника быть активным участником процесса рассуждений и полагаться на сознательную и эмоционально нейтральную обработку информации, а не на интуицию.

Но как же уменьшить собственную склонность к подтверждению? Здесь способы очень схожи с методами, описываемыми выше. Первый и самый важный шаг к преодолению собственной предвзятости подтверждения состоит в осознании своего процесса рассуждения.

Рассуждая, нужно постоянно спрашивать себя: «Не искажаю ли я восприятие сведений, пытаясь подтвердить свои убеждения?» Следует избегать преждевременной формулировки предположений и заставлять себя искать причины, по которым ваша первоначальная гипотеза может быть неверной.

Подобная работа над собой, помимо помощи в преодолении предвзятости подтверждения, имеет еще одно важное дополнительное преимущество: вы лучше начинаете понимать противоположную точку зрения. А это в свою очередь имеет решающее значение для способности отстаивать свою собственную позицию и конструктивно общаться на различные темы с окружающими, что в наше время – достаточно большая редкость.

Так что советуем вам более осознанно относиться не только к тому, что вы думаете, но и к тому, как именно вы это делаете и почему. Уверяем вас, такой подход позволит вам избежать огромного количества неприятностей и добиться в жизни намного лучших результатов!

С некоторой долей уверенности можно сказать, что все люди любят быть правыми. При этом объективно правым остаться можно далеко не всегда — зато всегда можно прибегнуть к субъективным суждениям, которые, при правильной их интерпретации, сыграют вам на руку и подтвердят сложившееся у вас мнение (или же опровергнут мнение вашего оппонента). О том, почему люди склонны искать доводы в пользу собственных суждений, а также о том, зачем по-разному интерпретировать один и тот же факт, читайте в нашем новом блоге о когнитивных искажениях.

Предвзятостью подтверждения (в англоязычной литературе используется термин ‘confirmation bias’) принято называть стремление человека к доказательству собственного мнения. Устроено это когнитивное искажение достаточно сложно: в его рамках действуют — раздельно или совместно — три механизма предвзятого суждения о действительности.

Первый — предвзятый поиск информации. Среди тех, кто склонен к такому поиску, заметное место принадлежит конспирологам. Так, сторонники так называемого «лунного заговора» уверены, что космическая программа «Аполлон» была полностью фальсифицирована, высадка на Луну никогда не производилась, а все существующие материалы-доказательства были отсняты на Земле. Несмотря на то, что многие (в том числе и советские — и это при набиравшей обороты космической гонке) ученые и космонавты выражали скепсис по поводу возможности такого заговора — действительно, организовать фальсификацию такого уровня чуть ли не так же сложно, как и саму космическую экспедицию, — его сторонники постоянно оперируют неопровержимыми, по их мнению, доказательствами вроде развевающегося в вакууме американского флага.

Второй аспект предвзятости подтверждения — предвзятая интерпретация. Понятно, что практически любую информацию, а также исход любого события можно интерпретировать двояко: стоит вспомнить, к примеру, известный казус с синими занавесками, которые «символизируют глубокую депрессию главного героя» для учителя литературы, но на самом деле — по задумке автора — просто синие. Человек, имеющий собственное устоявшееся мнение по определенному вопросу, под влиянием предвзятости подтверждения истолкует новую информацию в пользу того, что он думает. Причем от самой информации это зависит мало.

В качестве примера такой ситуации можно провести недавнее исследование, в ходе которого ученые изучали влияние информации о работе оппозиционной партии на политические настроения американцев. В течение месяца участники-республиканцы читали твиты, которые в их ленту добавляют боты-демократы, а демократы, наоборот, получали информацию о работе оппозиционной республиканской партии.

По окончании эксперимента политические взгляды каждой стороны не изменились, а, наоборот, усилились: получая информацию о том, как обстоят дела у политической оппозиции, участники, судя по всему, убеждались в том, что их взгляды — единственные правильные, трактуя любую — даже позитивную информацию — в негативном ключе. Любопытно, что боты-оппозиционеры сильнее повлияли на республиканцев, которые стали еще консервативнее. Из этого можно сделать вывод, что частота возникновения предвзятости подтверждения может быть обусловлена некоторыми факторами, например личностными характеристиками, такими как уверенность в себе и своей правоте.

Третий аспект — предвзятость памяти: люди, стремящиеся доказать свою точку зрения, будут вспоминать и использовать доказательства в свою пользу.

В качестве примера можно привести исследование, проведенное американскими исследователями Марком Снайдером (Mark Snyder) и Нэнси Кэнтор (Nancy Cantor) в конце 70-х годов. В ходе их эксперимента участникам предоставили подробное описание из жизни девушки по имени Джейн, а затем — разделив добровольцев на две группы — попросили их предъявить доводы в пользу и против того, чтобы девушку взяли на работу библиотекарем или риелтором. Те участники, которым необходимо было «устроить» Джейн в библиотеку, отмечали, что девушка — тихий интроверт, а те, кому необходимо было сделать Джейн успешным риелтором, чаще отмечали те качества, которые показывают ее общительным экстравертом.

Что касается факторов, влияющих на предвзятое использование воспоминаний, то среди них ученые прежде всего выделяют эмоции: со временем эмоциональная реакция на конкретные события ослабевает (недаром часто говорят, что время лечит), поэтому люди могут ошибочно оценивать свою уже прошедшую реакцию либо как более слабую, либо более сильную по сравнению с тем, какой она была на самом деле.

Объясняют возникновение предвзятости подтверждения обычно с оглядкой на две разные стратегии мышления: когнитивную и мотивированную. Первая заключается в том, что умственные ресурсы человека достаточно ограничены и, вместо того, чтобы взвешивать все плюсы и минусы двух противоположных подходов, он выбирает один — тот, который кажется ему наиболее осмысленным и доводы в пользу (а не против!) которого подобрать легче всего. Вторая стратегия действует во многом с оглядкой на эмоции, а точнее — на желания: человек склонен искать и находить доводы в пользу того, исполнения чего (порой бессознательно) ему бы очень хотелось.

В отличие от многих когнитивных искажений, предвзятость подтверждения не так безобидна. Интерпретация информации в угоду собственной выгоде и мнению негативно отражается, к примеру, на многих научных сферах, в частности в социальных науках. Собирая данные для проверки определенной гипотезы, ученые обычно надеются на то, что она подтвердится, поэтому данные, которые этому противоречат, зачастую считаются неудачными, а результаты таких работ остаются неопубликованными. В результате получается, что определенное поле остается плохо изученным, а исследователи могут наткнуться на достаточно распространенную проблему: нерелевантность используемых для проверки гипотезы методов уже подтвердилась, но об этом никто не знает, потому что публиковать работу с отрицательными результатами мало кому хочется. Более того, даже готовые такие работы могут попросту не принять к публикации: предвзято мыслить может и комиссия рецензентов.

На избавлении от предвзятости подтверждения, кстати, основаны некоторые принципы когнитивно-поведенческой психотерапии (и это также говорит о том, что это когнитивное искажение отнюдь не безобидно). Автор этого метода, американский психиатр Аарон Бек (ему и его коллегами также принадлежит и идея создания знаменитой шкалы депрессии Бека, используемой в диагностике психических расстройств уже более полувека), утверждал, что склонность к подтверждению собственного мнения может быть одним из симптомов депрессии.

В какой-то мере это действительно так: склонные к депрессии люди чаще всего настроены на пессимистичные мысли и негативную интерпретацию событий, и малейшие неудачи служат для них доказательством беспросветности будущего, в то время как успехи, наоборот, отвергаются. То же самое касается и людей с тревожным расстройством: собрав немного информации в пользу реальности своей тревоги, человек зацикливается на них, игнорируя информацию, потенциально способную опровергнуть нездоровое суждение. Когнитивно-поведенческая терапия учит интерпретировать информацию беспристрастно и, по возможности, ограничивать негативные оценочные суждения (которые в случае психических расстройств зачастую преобладают при двоякой интерпретации).

Впрочем, как бы опасны ни были негативное мышление и пессимизм для психического здоровья человека, предвзятое подтверждение может быть опасно и в позитивном ключе. Например, люди, уверенные в собственной правоте и неотразимости, могут запросто игнорировать адекватную критику в свой адрес. Так что как бы здорово ни было всегда оказываться правым, гораздо выигрышнее быть реалистами, трезво оценивать ситуацию и непредвзято интерпретировать всю известную информацию. По крайней мере, насколько это возможно.

Всем привет! На связи редакция самого крупного telegram-канала о нейромаркетинге.

Склонность к подтверждению своей точки зрения (англ. confirmation bias), или предвзятость подтверждения, — тенденция человека искать и интерпретировать такую информацию или отдавать предпочтение такой информации, которая согласуется с его точкой зрения, убеждением или гипотезой.

Разновидность когнитивного искажения и систематической ошибки индуктивного мышления

Эффект проявляется сильнее в отношении эмоционально значимых вопросов и глубоко укоренившихся убеждений. Люди также склонны интерпретировать неоднозначные свидетельства таким образом, чтобы поддерживалась их точка зрения.

Предвзятым поиском, толкованием и запоминанием объясняются такие эффекты, как эффект поляризации взглядов (когда разногласия становятся ещё сильнее, несмотря на то что сторонам были представлены одни и те же свидетельства), эффект стойкости убеждения belief perseverance, когда мнение сохраняется даже тогда, когда поддерживающие его свидетельства были опровергнуты), эффект первичности (англ. primacy effect, склонность отдавать предпочтение информации, полученной первой), иллюзорная корреляция (склонность видеть взаимосвязь между двумя явлениями или ситуациями там, где её нет).

Ряд экспериментов, проведённых в 1960-х годах, показал, что люди склонны подтверждать имеющиеся у них убеждения. Последующие исследования дали основания пересмотреть эти результаты и выдвинуть идею о склонности людей проверять их гипотезы в предвзятом виде, фокусировать внимание только на одной возможности и игнорировать альтернативные. В некоторых ситуациях эта тенденция может искажать выводы людей.

Объяснениями наблюдаемых когнитивных искажений могут быть эффект принятия желаемого за действительное и ограниченная способность человека перерабатывать информацию. Ещё одно объяснение заключается в том, что люди скорее склонны взвешивать потери от признания своей неправоты, вместо того чтобы оценивать ситуацию в нейтральном, научном стиле.

Склонность к подтверждению влияет на излишнюю самоуверенность человека в собственных суждениях и может поддерживать и усиливать убеждения при получении доказательств обратного. Эти когнитивные искажения находят отражение в плохих решениях принимаемых в политическом и организационном контекстах

Как можно извлечь выгоду из этого эффекта:

— В маркетинге следует избегать чрезмерных обещаний и возвеличивания своего продукта, независимо от того, правда это или нет. Если вы опишите свой продукт как «он слишком хорош, чтобы быть правдой», то люди так и подумают: это звучит слишком хорошо, чтобы быть правдой;

— Покажите потенциальным покупателям силу действия своего продукта через примеры реальных покупателей, которым он уже помог решить их проблемы, а не через голословное восхваление его достоинств и преимуществ. И даже в этом случае не следует обещать невозможного, как, например, это делает AXE.

Подтверждающее искажение

Подтверждающее искажение (confirmation bias) — одно из главных когнитивных искажений, незаметно заправляющих нашими решениями и убеждениями. Как пишет James Clear, «The Grandaddy of Them All».

Суть

Определние из википедии:

подтверждающее искажение — свойство человека искать, интерпретировать, выбирать и запоминать информацию так, что она подтверждает его предшествующие убеждения и гипотезы

Чтобы стало понятнее, вот пример. Знакомьтесь, это Соня. Соня — очень прогрессивная девочка и любит новые технологии.

<на картинке футуристичная соня на футуристичных роликах, в футуристичных наушниках и с ещё какой-нибудь киберфигнёй типа VR очков>

Соня считает, что прогресс велик, и миссия современного человека — как можно быстрее вводить инновации и развивать технологии. Она и сама в этом участвует.

<Соня сидит за компом и с энтузиазмом прогает>

Всё окружение Сони… я усталь писать

<Соня со своим прогрессивным окружением>

Соня любит читать фантастические книжки про то, как учёные будущего сделали летающие машины, и статьи про то, как биологи и медики смогут отодвинуть возраст старения.

<Cоня за компом читает посты про прогресс, например, клёвые биотехнологии для инвалидов и вслух восхищается>

А вот Оля, сонина сестра. Она настороженно относится к новым технологиям и опасается, что они могут принести больше вреда, чем пользы. Она не любит современные мегаполисы и предпочитает Старое, Доброе и Надёжное.

<Оля стоит на приороде и радуется, какой здесь свежий воздух и нет машин и небоскрёбов>

Оля сердится, что современные девайсы отнимают у людей время и делают их глупее. И проводит свободное время с людьми, которые разделяют её взгляды.

<Оля и какой-то чел сидят у камина, читают бумажные книжки про старые добрые времена, обсуждают, как технологии убивают человечество>

Всё, я усталь, потом дальше придумаю. Там будет ещё про то, что каждая обращает внимание на факты в свою пользу, а потом в конце эпичный эпизод, который каждая трактует в пользу своих взглядов.

<Картинка: авто- или чото ещё- катастрофа>

<Соня и Оля кричат друг другу: «Вот видишь, до чего этот твой прогресс доводит?!», «Вот видишь, как важно совершенствовать технологии, чтобы такого не было?!»>

Вне зависимости от того, кто из девушек прав, обе находятся под влиянием подтверждающего искажения.

Получается, что подтверждающее искажение выглядит вот так (фото стянуто из блога James Clear):

(О, а тут тоже можно нарисовать чото своё, стилизованное!)

История и исследования

Открыл данное искажение психолог Питер Вэйн. В 1960-м году он провел эксперимент, в котором испытуемым предъявлялась определенная серия чисел (например, 2, 4, 6).

Вышеприведенное упражнение основано на классическом эксперименте Питера Уэйсона, задаче «2-4-6». Несмотря на то, что испытуемые, которым дают эту задачу, выражают большую уверенность в своих предположениях, только 21% из них успешно угадывают задуманное экспериментатором правило, и все повторные опыты продолжали показывать тот же уровень успехов в районе 20%.

Исследование называлось «On the failure to eliminate hypotheses in a conceptual task» (Еженедельник экспериментальной психологии 12: 129-140, 1960). Испытуемые, которым предлагалась задача «2-4-6», обычно пытались придумать положительные примеры, а не негативные — они применяли гипотетическое правило для создания триплета, а потом смотрели, будет ли он отмечен как «да». (https://lesswrong.ru/w/%D0%9F%D0%BE%D0%B4%D1%82%D0%B2%D0%B5%D1%80%D0%B6%D0%B4%D0%B0%D1%8E%D1%89%D0%B5%D0%B5_%D0%B8%D1%81%D0%BA%D0%B0%D0%B6%D0%B5%D0%BD%D0%B8%D0%B5_%D0%B2%D0%B7%D0%B3%D0%BB%D1%8F%D0%B4_%D0%B2%D0%BE_%D1%82%D1%8C%D0%BC%D1%83)

Типы подтверждающего искажения и Больше Примеров

ГМО или не ГМО: предвзятый поиск информации

Давайте вернёмся к Соне и Оле. Помните, как каждая из них читала только то, что подтверждало её точку зрения?

…

Приведём ещё один пример. Допустим, вы любите здоровый образа жизни и следите за своим питанием. И, разумеется, вас не обошла горячая тема ГМО. Со всех прилавков магазинов здорового питания на Вас смотрят гордые этикекетки не содержит ГМО, что уже заставляет Вас относиться к ГМО продуктам настороженно. Но Вы решили поглубже разобраться в теме, и как истинный обитатель 21 века, начали гуглить. По запросу «вред ГМО» …

чото такое:

Теперь, когда Вы сделали самостоятельное исследование темы и нашли весьма убедительные подтверждения своим опасениям, Вам сложно осознать, что всё это время Вы были подвержены эффекту подтверждающего искажения. Как же: ведь все статьи в интернете, которые Вы прочитали, говорили в пользу вредя ГМО. …

Предвзятая интерпретация фактов и Политека (пожалуйста не бейте)

И снова о Соне и Оле. Помните эпизод с аварией, который каждая из них интерпретировала в пользу своих взглядов? Иногда …

Арсений придерживается таких-то политических взглядов и поддерживает кандидата X. Арсений общается с разумными и логичными людьми, ведь они разделяют его мировоззрение и взгляды на политику. А сестра Арсения Лиза ничего не понимает в политике, и поддерживает каких-то идиотов, которые, дай им в руки власть, приведут страну в пропасть. Как разумный человек и хороший брат, Арсений соглашается выслушать точку зрения Лизы. Арсений очень гордится тем, что он настолько рационален и воспитан, что способен выслушать своего оппонента. (Прим. автора: даже среди образованных и интеллигентных людей много таких, кто попросту не будет слушать чловека, не принадлежащего к его группе убеждений. Например, неглупые девушки-феминистки по какому-то вопросу вполне могут искренне сказать что-то вроде «Зачем вообще слушать мнение мальчика?!», не замечая, что таким образом в принципе отрезают возможность коммуникации с «той стороной баррикад»). (прим. прим. автора до публикации: так, я чото разгорячаюсь. мб не писать обо всём этом? я не хочу холивара :/ ) Лиза радуется и …

Пример про автора: искаженные воспоминания

А вот пример из моей жизни. Давно-давно, когда я была маленькой и наивной, трава была зеленее, а солнце ярче… — в общем, в далёком 2015 — я искренне верила, что если откусить от времени своего сна треть (а то и целую половину!) чтобы вместо этого сделать что-то полезное и важное, дела сделаются быстрее, на экзамене я отвечу лучше и вообще буду Герой и Молодец. А если забить на все дела и пойти спать, …

Дисклэймер: я решила приводить в описании когнитивных примеры из своей жизни не для того, чтобы показать, какая я рефлексивная умница (это конечно вне всяких сомнений), а чтобы побудить читателя делать то же самое.

Польза и вред

Польза

У подтвеждающего искажения, как и у всех других когнитивных искажений, есть какая-то разумная и полезная причина к существованию.

Вред

Но раз оно полезное, зачем тогда держать его в уме? Почему бы просто не вести себя естественным образом дальше радостно жить в комфорте со своими убеждениями?

…

Как бороться

Изменять свою точку зрения сложнее, чем кажется. Но для тех, кто осознанно задаётся целью внимательно следить за истинностью своих убеждений …

-

What do you think you know, and how do you think you know it?

-

Следить за разнородностью информации

-

Попробуйте применить полученные знания к себе

А теперь, прочитав всё это, попробуйте вспомнить случай, когда вы были подверженны подтверждающему искажению. NB: Это может быть очень непросто, потому что найти у себя подтверждающее искажение значит поставить какие-то из своих убеждений под сомнение, а все наши убеждения, по понятным причинам, кажутся нам достоверными и логичными.

(Картинка про «потому что я ему не подвержен»!)

Выйти из этого положения можно, попытавшись вспомнить одно из своих предыдущих убеждений, которое больше не кажется вам истинным, и подумать, как

Такие дела!

(И не забудьте, что подтверждающее искажение возможно даже по поводу… подтверждающего искажения).

О нас

- Автор поста: Маша Шеянова

- Художник: Настя Пескова (aka Плуто)

Что ещё почитать

- Элиезер Юдковский: русский перевод

Человеческий мозг несовершенен и часто выдает ошибочные убеждения за чистую монету, но мы не в состоянии увидеть ошибку своего мышления. В той или иной степени когнитивные искажения свойственны каждому человеку, и порой мы видим их в ретроспективе (уже после события, когда «после боя кулаками не машут»).

№1 Endowment Effect (Эффект обладания)

Мы склонны оценивать стоимость того, чем мы владеем выше, чем стоимость того, что нам еще только предстоит купить. Ценность предмета повышается после того, как мы его приобрели. Впервые этот феномен был продемонстрирован в ходе эксперимента Талера и Канемана в Корнеллском университете. Группу студентов разделили на 2 подгруппы. Первой подгруппе подарили чашки стоимостью 6 долларов, а второй группе не подарили ничего. Второй группе предложили купить чашки у первой группы. Участники первой группы оценили «подарок» в 5,25 дол. Тогда как участники второй группы предлагали максимальную цену в 2,75 дол. Подобнее об эксперименте: Experimental Tests of the Endowment Effect and the Coase Theorem (D. Kahneman, J. Knetsch, R. Thaler, 1990).

Похожую ситуацию мы наблюдаем, когда владелец автомобиля склонен оценивать его выше рыночной цены при продаже, тогда как покупатели всегда предлагают цену меньше. Иногда это приводит к тому, что мы не готовы продать какую-то вещь (в бизнесе это может быть продажа доли акций, или ТМ, или другой собственности) по объективной рыночной цене только потому, что мы ей уже владеем.

Преодолеть эффект обладания поможет выход в так называемую мета-позицию. Необходимо отстраниться от эмоций, связанных с этим предметом, представить себя в роли стороннего наблюдателя и посмотреть на предмет как на новый, не принадлежащий вам. Задать себе вопрос: за сколько вы бы его купили? Его стоимость, вероятно, изменится. Данную практику на сеансах применяют бизнес-психологи, она называется Трехпозиционное восприятие, и часто она помогает собственнику компании принять очищенное от эмоций решение о продаже компании или joint venture.

№2 Confirmation bias (Склонность к подтверждению своей точки зрения)

Наш мозг фильтрует информацию так, чтобы выделить факты, которые подтверждают «приятное нам мнение» и отвергают противоположное. Это систематическая ошибка индуктивного мышления. Этот эффект особенно часто проявляется, когда речь идет об эмоционально значимом для человека вопросе, касающемся его корневого убеждения. В бизнесе, и в частности, связанном с финансами и биржевой торговлей, это проявляется в том, что трейдер чаще принимает решение об инвестировании, если рыночный тренд коррелирует с его мнением. Например, если трейдер уверен, что рынок медицинского оборудования растет, он будет с одобрением принимать подтверждающую информацию, и игнорировать или более критично относиться к информации, опровергающей его мнение. Подробнее об этом когнитивном искажении: Zweig, Jason (November 19, 2009), How to Ignore the Yes-Man in Your Head, Dow Jones & Company. А также Pompian, Michael M. (2006), Behavioral finance and wealth management: how to build optimal portfolios that account for investor biases, John Wiley and Sons.

Преодолеть склонность к подтверждению своей точки зрения можно снижением эмоциональной составляющей. Та самая беспристрастность — когда лично вам все равно – позволяет принять более взвешенное решение. Следующий шаг: разрешить себе право на ошибку. Не ошибается только тот, кто ничего не делает. Разрешая себе ошибаться и исправлять ошибки, вы не будете бояться, что ваше мнение окажется ложным. Также следует отделять повторение от первоисточника. Например, ложная информация часто тиражируется в нескольких источниках, и в результате создается впечатление, что это истина. Беспристрастная проверка информации, обращение к первоисточникам (государственный сайт, официальный отчет о годовой выручке компании, итд) позволят прояснить картину.

№3 Dunning–Kruger effect (Эффект Даннинга-Крюгера)

Некомпетентные люди, которые менее квалифицированы в вопросе, чаще склонны думать, что все знают и делиться своим мнением. Так, например, когда человек только начал изучать предмет и получил первые знания, он начинает считать себя экспертом и охотно делится новыми знаниями. Со временем, чем больше он узнает, тем четче понимает, что ничего не знает, и тем меньше кричит о своих знаниях со всех углов. Со временем, приобретая знания и опыт, человек выходит на плато стабильности. Данный эффект в 1999 году описали Джастин Крюгер и Дэвид Даннинг, ссылаясь на Чарльза Дарвина и Бертрана Рассела (Kruger, Justin; David Dunning. Unskilled and Unaware of It: How Difficulties in Recognizing One’s Own Incompetence Lead to Inflated Self-Assessments // Journal of Personality and Social Psychology : journal. — 1999).

Каждый человек в той или иной сфере сталкивается с эффектом Даннинга-Крюгера. Для руководителей он часто проявляется в том, что, изучив немного новую сферу, они склонны принимать решения, основываясь на уверенности в своей новой компетенции. Преодолеть эффект можно, научившись принимать конструктивную критику, обращаясь к экспертам в данном вопросе, и делегированию. Однажды осознав эффект Даннинга-Крюгера на себе, в будущем человек, как правило, более критично оценивает свою компетенцию в новой области знаний.

№4 Черно-белое мышление (Splitting или black-and-white thinking)

Черно-белое мышление, или расщепление – это мышление в крайности. Например, «только кола, пепси- отстой», «все люди этой африканской страны – глупые», «моя бывшая – ужасный человек» и так далее. Категоричное, однозначное мышление в отношении определенного объекта или субъекта лишает нас объективности и заставляет принимать неверные решения. Мышление категориями «Я успешен» или «Я неудачник» накладывают ограничения для роста и развития. Подробнее о влиянии черно-белого мышления можно прочесть в работе «The defense mechanism of splitting: Developmental origins, effects on staff, recommendations for nursing care». Journal of Psychiatric Nursing and Mental Health Services. Carser, D. (1979).

Чтобы убрать у себя черно-белое мышление, попробуйте отслеживать в вашей речи такие слова как «все», «всегда», «никогда» — обобщения явлений, людей, категоричные суждения. Ставьте свою точку зрения под сомнения, спрашивайте себя «Могу ли я быть неправ? Есть ли факты, опровергающие мое убеждение?». Принятие чужой точки зрения, принятие своей собственной неправоты помогает справиться с черно-белым мышлением, которое может привести к ухудшению в карьере и отношениях. Вспомните случаи, когда вы ожесточенно отстаивали свою точку зрения, но в результате оказались неправы. Если таких случаев не было, и у вас есть установка «я всегда прав», «я знаю о чем говорю», это хороший повод обратиться к КПТ (когнитивно-бихевиоральной терапии).

№5 False consensus effect (Эффект ложного согласия)

Мы склонны думать, что наше восприятие ситуации присуще большинству, что наше мнение наиболее популярно. Например, если нам больше нравится читать сообщения текстом, чем принимать телефонные звонки, мы склонны думать, что это удобно большинству людей. Или если нас раздражают чересчур навязчивые и шумные люди, мы склонны считать, что они раздражают всех. В результате Эффект ложного согласия приводит к фиаско многих старт-апов, фаундеры которых думали, что пользователи считают так же, как они. Этот эффект хорошо известен UX-разработчикам, которые знают, что они — не все пользователи своего софта, и А/В-тестирование может показать совсем другие результаты, отличные от их мнения. В результате это может существенно повлиять на конечный результат продукта. Подробнее об эффекте ложного согласия можно прочесть в работе Bauman, Kathleen P.; Geher, Glenn (2002). «We think you agree: The detrimental impact of the false consensus effect on behavior». Current Psychology.

Бороться с эффектом ложного согласия можно, проводя опросы своей целевой аудитории. В случае с запуском продукта – тестирование, фокус-группы. Например, если вы считаете, что большинство коллег думают так же, как и вы – спросите их, и подсчитайте количество мнений.

С когнитивными искажениями успешно борется КПТ (когнитивно-поведенческая терапия). Иногда на сеансе психолога можно увидеть, что ваше убеждение не соответствует действительности и только лишь отравляет вам жизнь, и избавиться от него буквально за 1 сеанс.

Я заранее прошу прощения, что не смогу отвечать на комментарии (в одной из предыдущих статей их более 100 и я, к сожалению, уже не читаю комментарии), поэтому если у вас будут вопросы, на которые вы хотите получить мой ответ – пишите, пожалуйста, в личные сообщения. Спасибо, что прочитали статью до конца

Confirmation bias is the tendency to search for, interpret, favor, and recall information in a way that confirms or supports one’s prior beliefs or values.[1] People display this bias when they select information that supports their views, ignoring contrary information, or when they interpret ambiguous evidence as supporting their existing attitudes. The effect is strongest for desired outcomes, for emotionally charged issues, and for deeply entrenched beliefs. Confirmation bias cannot be eliminated, but it can be managed, for example, by education and training in critical thinking skills.

Biased search for information, biased interpretation of this information, and biased memory recall, have been invoked to explain four specific effects:

- attitude polarization (when a disagreement becomes more extreme even though the different parties are exposed to the same evidence)

- belief perseverance (when beliefs persist after the evidence for them is shown to be false)

- the irrational primacy effect (a greater reliance on information encountered early in a series)

- illusory correlation (when people falsely perceive an association between two events or situations).

A series of psychological experiments in the 1960s suggested that people are biased toward confirming their existing beliefs. Later work re-interpreted these results as a tendency to test ideas in a one-sided way, focusing on one possibility and ignoring alternatives. Explanations for the observed biases include wishful thinking and the limited human capacity to process information. Another proposal is that people show confirmation bias because they are pragmatically assessing the costs of being wrong, rather than investigating in a neutral, scientific way.

Flawed decisions due to confirmation bias have been found in a wide range of political, organizational, financial and scientific contexts. These biases contribute to overconfidence in personal beliefs and can maintain or strengthen beliefs in the face of contrary evidence. For example, confirmation bias produces systematic errors in scientific research based on inductive reasoning (the gradual accumulation of supportive evidence). Similarly, a police detective may identify a suspect early in an investigation, but then may only seek confirming rather than disconfirming evidence. A medical practitioner may prematurely focus on a particular disorder early in a diagnostic session, and then seek only confirming evidence. In social media, confirmation bias is amplified by the use of filter bubbles, or «algorithmic editing», which display to individuals only information they are likely to agree with, while excluding opposing views.

Definition and context[edit]

Confirmation bias, a phrase coined by English psychologist Peter Wason, is the tendency of people to favor information that confirms or strengthens their beliefs or values and is difficult to dislodge once affirmed.[2] Confirmation bias is an example of a cognitive bias.

Confirmation bias (or confirmatory bias) has also been termed myside bias.[a] «Congeniality bias» has also been used.[4]

Confirmation biases are effects in information processing. They differ from what is sometimes called the behavioral confirmation effect, commonly known as self-fulfilling prophecy, in which a person’s expectations influence their own behavior, bringing about the expected result.[5]

Some psychologists restrict the term «confirmation bias» to selective collection of evidence that supports what one already believes while ignoring or rejecting evidence that supports a different conclusion. Others apply the term more broadly to the tendency to preserve one’s existing beliefs when searching for evidence, interpreting it, or recalling it from memory.[6][b]

Confirmation bias is a result of automatic, unintentional strategies rather than deliberate deception.[8][9] Confirmation bias cannot be avoided or eliminated, but only managed by improving education and critical thinking skills.

Confirmation bias is a broad construct that has a number of possible explanations, namely: hypothesis-testing by falsification, hypothesis testing by positive test strategy, and information processing explanations.

Types of confirmation bias[edit]

Biased search for information[edit]

Experiments have found repeatedly that people tend to test hypotheses in a one-sided way, by searching for evidence consistent with their current hypothesis.[1]: 177–178 [11] Rather than searching through all the relevant evidence, they phrase questions to receive an affirmative answer that supports their theory.[12] They look for the consequences that they would expect if their hypothesis was true, rather than what would happen if it was false.[12] For example, someone using yes/no questions to find a number they suspect to be the number 3 might ask, «Is it an odd number?» People prefer this type of question, called a «positive test», even when a negative test such as «Is it an even number?» would yield exactly the same information.[13] However, this does not mean that people seek tests that guarantee a positive answer. In studies where subjects could select either such pseudo-tests or genuinely diagnostic ones, they favored the genuinely diagnostic.[14][15]

The preference for positive tests in itself is not a bias, since positive tests can be highly informative.[16] However, in combination with other effects, this strategy can confirm existing beliefs or assumptions, independently of whether they are true.[8] In real-world situations, evidence is often complex and mixed. For example, various contradictory ideas about someone could each be supported by concentrating on one aspect of his or her behavior.[11] Thus any search for evidence in favor of a hypothesis is likely to succeed.[8] One illustration of this is the way the phrasing of a question can significantly change the answer.[11] For example, people who are asked, «Are you happy with your social life?» report greater satisfaction than those asked, «Are you unhappy with your social life?»[17]

Even a small change in a question’s wording can affect how people search through available information, and hence the conclusions they reach. This was shown using a fictional child custody case.[18] Participants read that Parent A was moderately suitable to be the guardian in multiple ways. Parent B had a mix of salient positive and negative qualities: a close relationship with the child but a job that would take them away for long periods of time. When asked, «Which parent should have custody of the child?» the majority of participants chose Parent B, looking mainly for positive attributes. However, when asked, «Which parent should be denied custody of the child?» they looked for negative attributes and the majority answered that Parent B should be denied custody, implying that Parent A should have custody.[18]

Similar studies have demonstrated how people engage in a biased search for information, but also that this phenomenon may be limited by a preference for genuine diagnostic tests. In an initial experiment, participants rated another person on the introversion–extroversion personality dimension on the basis of an interview. They chose the interview questions from a given list. When the interviewee was introduced as an introvert, the participants chose questions that presumed introversion, such as, «What do you find unpleasant about noisy parties?» When the interviewee was described as extroverted, almost all the questions presumed extroversion, such as, «What would you do to liven up a dull party?» These loaded questions gave the interviewees little or no opportunity to falsify the hypothesis about them.[19] A later version of the experiment gave the participants less presumptive questions to choose from, such as, «Do you shy away from social interactions?»[20] Participants preferred to ask these more diagnostic questions, showing only a weak bias towards positive tests. This pattern, of a main preference for diagnostic tests and a weaker preference for positive tests, has been replicated in other studies.[20]

Personality traits influence and interact with biased search processes.[21] Individuals vary in their abilities to defend their attitudes from external attacks in relation to selective exposure. Selective exposure occurs when individuals search for information that is consistent, rather than inconsistent, with their personal beliefs.[22] An experiment examined the extent to which individuals could refute arguments that contradicted their personal beliefs.[21] People with high confidence levels more readily seek out contradictory information to their personal position to form an argument. This can take the form of an oppositional news consumption, where individuals seek opposing partisan news in order to counterargue.[23] Individuals with low confidence levels do not seek out contradictory information and prefer information that supports their personal position. People generate and evaluate evidence in arguments that are biased towards their own beliefs and opinions.[24] Heightened confidence levels decrease preference for information that supports individuals’ personal beliefs.

Another experiment gave participants a complex rule-discovery task that involved moving objects simulated by a computer.[25] Objects on the computer screen followed specific laws, which the participants had to figure out. So, participants could «fire» objects across the screen to test their hypotheses. Despite making many attempts over a ten-hour session, none of the participants figured out the rules of the system. They typically attempted to confirm rather than falsify their hypotheses, and were reluctant to consider alternatives. Even after seeing objective evidence that refuted their working hypotheses, they frequently continued doing the same tests. Some of the participants were taught proper hypothesis-testing, but these instructions had almost no effect.[25]

Biased interpretation of information[edit]

Smart people believe weird things because they are skilled at defending beliefs they arrived at for non-smart reasons.

—Michael Shermer[26]

Confirmation biases are not limited to the collection of evidence. Even if two individuals have the same information, the way they interpret it can be biased.

A team at Stanford University conducted an experiment involving participants who felt strongly about capital punishment, with half in favor and half against it.[27][28] Each participant read descriptions of two studies: a comparison of U.S. states with and without the death penalty, and a comparison of murder rates in a state before and after the introduction of the death penalty. After reading a quick description of each study, the participants were asked whether their opinions had changed. Then, they read a more detailed account of each study’s procedure and had to rate whether the research was well-conducted and convincing.[27] In fact, the studies were fictional. Half the participants were told that one kind of study supported the deterrent effect and the other undermined it, while for other participants the conclusions were swapped.[27][28]

The participants, whether supporters or opponents, reported shifting their attitudes slightly in the direction of the first study they read. Once they read the more detailed descriptions of the two studies, they almost all returned to their original belief regardless of the evidence provided, pointing to details that supported their viewpoint and disregarding anything contrary. Participants described studies supporting their pre-existing view as superior to those that contradicted it, in detailed and specific ways.[27][29] Writing about a study that seemed to undermine the deterrence effect, a death penalty proponent wrote, «The research didn’t cover a long enough period of time,» while an opponent’s comment on the same study said, «No strong evidence to contradict the researchers has been presented.»[27] The results illustrated that people set higher standards of evidence for hypotheses that go against their current expectations. This effect, known as «disconfirmation bias», has been supported by other experiments.[30]

Another study of biased interpretation occurred during the 2004 U.S. presidential election and involved participants who reported having strong feelings about the candidates. They were shown apparently contradictory pairs of statements, either from Republican candidate George W. Bush, Democratic candidate John Kerry or a politically neutral public figure. They were also given further statements that made the apparent contradiction seem reasonable. From these three pieces of information, they had to decide whether each individual’s statements were inconsistent.[31]: 1948 There were strong differences in these evaluations, with participants much more likely to interpret statements from the candidate they opposed as contradictory.[31]: 1951

An MRI scanner allowed researchers to examine how the human brain deals with dissonant information.

In this experiment, the participants made their judgments while in a magnetic resonance imaging (MRI) scanner which monitored their brain activity. As participants evaluated contradictory statements by their favored candidate, emotional centers of their brains were aroused. This did not happen with the statements by the other figures. The experimenters inferred that the different responses to the statements were not due to passive reasoning errors. Instead, the participants were actively reducing the cognitive dissonance induced by reading about their favored candidate’s irrational or hypocritical behavior.[31]: 1956

Biases in belief interpretation are persistent, regardless of intelligence level. Participants in an experiment took the SAT test (a college admissions test used in the United States) to assess their intelligence levels. They then read information regarding safety concerns for vehicles, and the experimenters manipulated the national origin of the car. American participants provided their opinion if the car should be banned on a six-point scale, where one indicated «definitely yes» and six indicated «definitely no». Participants firstly evaluated if they would allow a dangerous German car on American streets and a dangerous American car on German streets. Participants believed that the dangerous German car on American streets should be banned more quickly than the dangerous American car on German streets. There was no difference among intelligence levels at the rate participants would ban a car.[24]

Biased interpretation is not restricted to emotionally significant topics. In another experiment, participants were told a story about a theft. They had to rate the evidential importance of statements arguing either for or against a particular character being responsible. When they hypothesized that character’s guilt, they rated statements supporting that hypothesis as more important than conflicting statements.[32]

Biased memory recall of information[edit]

People may remember evidence selectively to reinforce their expectations, even if they gather and interpret evidence in a neutral manner. This effect is called «selective recall», «confirmatory memory», or «access-biased memory».[33] Psychological theories differ in their predictions about selective recall. Schema theory predicts that information matching prior expectations will be more easily stored and recalled than information that does not match.[34] Some alternative approaches say that surprising information stands out and so is memorable.[34] Predictions from both these theories have been confirmed in different experimental contexts, with no theory winning outright.[35]

In one study, participants read a profile of a woman which described a mix of introverted and extroverted behaviors.[36] They later had to recall examples of her introversion and extroversion. One group was told this was to assess the woman for a job as a librarian, while a second group were told it was for a job in real estate sales. There was a significant difference between what these two groups recalled, with the «librarian» group recalling more examples of introversion and the «sales» groups recalling more extroverted behavior.[36] A selective memory effect has also been shown in experiments that manipulate the desirability of personality types.[34][37] In one of these, a group of participants were shown evidence that extroverted people are more successful than introverts. Another group were told the opposite. In a subsequent, apparently unrelated study, participants were asked to recall events from their lives in which they had been either introverted or extroverted. Each group of participants provided more memories connecting themselves with the more desirable personality type, and recalled those memories more quickly.[38]

Changes in emotional states can also influence memory recall.[39][40] Participants rated how they felt when they had first learned that O. J. Simpson had been acquitted of murder charges.[39] They described their emotional reactions and confidence regarding the verdict one week, two months, and one year after the trial. Results indicated that participants’ assessments for Simpson’s guilt changed over time. The more that participants’ opinion of the verdict had changed, the less stable were the participant’s memories regarding their initial emotional reactions. When participants recalled their initial emotional reactions two months and a year later, past appraisals closely resembled current appraisals of emotion. People demonstrate sizable myside bias when discussing their opinions on controversial topics.[24] Memory recall and construction of experiences undergo revision in relation to corresponding emotional states.

Myside bias has been shown to influence the accuracy of memory recall.[40] In an experiment, widows and widowers rated the intensity of their experienced grief six months and five years after the deaths of their spouses. Participants noted a higher experience of grief at six months rather than at five years. Yet, when the participants were asked after five years how they had felt six months after the death of their significant other, the intensity of grief participants recalled was highly correlated with their current level of grief. Individuals appear to utilize their current emotional states to analyze how they must have felt when experiencing past events.[39] Emotional memories are reconstructed by current emotional states.

One study showed how selective memory can maintain belief in extrasensory perception (ESP).[41] Believers and disbelievers were each shown descriptions of ESP experiments. Half of each group were told that the experimental results supported the existence of ESP, while the others were told they did not. In a subsequent test, participants recalled the material accurately, apart from believers who had read the non-supportive evidence. This group remembered significantly less information and some of them incorrectly remembered the results as supporting ESP.[41]

Individual differences[edit]

Myside bias was once believed to be correlated with intelligence; however, studies have shown that myside bias can be more influenced by ability to rationally think as opposed to level of intelligence.[24] Myside bias can cause an inability to effectively and logically evaluate the opposite side of an argument. Studies have stated that myside bias is an absence of «active open-mindedness», meaning the active search for why an initial idea may be wrong.[42] Typically, myside bias is operationalized in empirical studies as the quantity of evidence used in support of their side in comparison to the opposite side.[43]

A study has found individual differences in myside bias. This study investigates individual differences that are acquired through learning in a cultural context and are mutable. The researcher found important individual difference in argumentation. Studies have suggested that individual differences such as deductive reasoning ability, ability to overcome belief bias, epistemological understanding, and thinking disposition are significant predictors of the reasoning and generating arguments, counterarguments, and rebuttals.[44][45][46]

A study by Christopher Wolfe and Anne Britt also investigated how participants’ views of «what makes a good argument?» can be a source of myside bias that influences the way a person formulates their own arguments.[43] The study investigated individual differences of argumentation schema and asked participants to write essays. The participants were randomly assigned to write essays either for or against their preferred side of an argument and were given research instructions that took either a balanced or an unrestricted approach. The balanced-research instructions directed participants to create a «balanced» argument, i.e., that included both pros and cons; the unrestricted-research instructions included nothing on how to create the argument.[43]

Overall, the results revealed that the balanced-research instructions significantly increased the incidence of opposing information in arguments. These data also reveal that personal belief is not a source of myside bias; however, that those participants, who believe that a good argument is one that is based on facts, are more likely to exhibit myside bias than other participants. This evidence is consistent with the claims proposed in Baron’s article—that people’s opinions about what makes good thinking can influence how arguments are generated.[43]

Discovery[edit]

Informal observations[edit]

Before psychological research on confirmation bias, the phenomenon had been observed throughout history. Beginning with the Greek historian Thucydides (c. 460 BC – c. 395 BC), who wrote of misguided reason in The Peloponnesian War; «… for it is a habit of mankind to entrust to careless hope what they long for, and to use sovereign reason to thrust aside what they do not fancy».[47] Italian poet Dante Alighieri (1265–1321) noted it in the Divine Comedy, in which St. Thomas Aquinas cautions Dante upon meeting in Paradise, «opinion—hasty—often can incline to the wrong side, and then affection for one’s own opinion binds, confines the mind».[48] Ibn Khaldun noticed the same effect in his Muqaddimah:[49]

Untruth naturally afflicts historical information. There are various reasons that make this unavoidable. One of them is partisanship for opinions and schools. … if the soul is infected with partisanship for a particular opinion or sect, it accepts without a moment’s hesitation the information that is agreeable to it. Prejudice and partisanship obscure the critical faculty and preclude critical investigation. The result is that falsehoods are accepted and transmitted.

In the Novum Organum, English philosopher and scientist Francis Bacon (1561–1626)[50] noted that biased assessment of evidence drove «all superstitions, whether in astrology, dreams, omens, divine judgments or the like».[51] He wrote:[51]

The human understanding when it has once adopted an opinion … draws all things else to support and agree with it. And though there be a greater number and weight of instances to be found on the other side, yet these it either neglects or despises, or else by some distinction sets aside or rejects[.]

In the second volume of his The World as Will and Representation (1844), German philosopher Arthur Schopenhauer observed that «An adopted hypothesis gives us lynx-eyes for everything that confirms it and makes us blind to everything that contradicts it.»[52]

In his essay (1897) What Is Art?, Russian novelist Leo Tolstoy wrote:[53]

I know that most men—not only those considered clever, but even those who are very clever, and capable of understanding most difficult scientific, mathematical, or philosophic problems—can very seldom discern even the simplest and most obvious truth if it be such as to oblige them to admit the falsity of conclusions they have formed, perhaps with much difficulty—conclusions of which they are proud, which they have taught to others, and on which they have built their lives.

In his essay (1894) The Kingdom of God Is Within You, Tolstoy had earlier written:[54]

The most difficult subjects can be explained to the most slow-witted man if he has not formed any idea of them already; but the simplest thing cannot be made clear to the most intelligent man if he is firmly persuaded that he knows already, without a shadow of doubt, what is laid before him.

Hypothesis-testing (falsification) explanation (Wason)[edit]

In Peter Wason’s initial experiment published in 1960 (which does not mention the term «confirmation bias»), he repeatedly challenged participants to identify a rule applying to triples of numbers. They were told that (2,4,6) fits the rule. They generated triples, and the experimenter told them whether each triple conformed to the rule.[1]: 179

The actual rule was simply «any ascending sequence», but participants had great difficulty in finding it, often announcing rules that were far more specific, such as «the middle number is the average of the first and last».[55] The participants seemed to test only positive examples—triples that obeyed their hypothesized rule. For example, if they thought the rule was, «Each number is two greater than its predecessor,» they would offer a triple that fitted (confirmed) this rule, such as (11,13,15) rather than a triple that violated (falsified) it, such as (11,12,19).[56]

Wason interpreted his results as showing a preference for confirmation over falsification, hence he coined the term «confirmation bias».[c][58] Wason also used confirmation bias to explain the results of his selection task experiment.[59] Participants repeatedly performed badly on various forms of this test, in most cases ignoring information that could potentially refute (falsify) the specified rule.[60][61]

Hypothesis testing (positive test strategy) explanation (Klayman and Ha)[edit]

Klayman and Ha’s 1987 paper argues that the Wason experiments do not actually demonstrate a bias towards confirmation, but instead a tendency to make tests consistent with the working hypothesis.[16][62] They called this the «positive test strategy».[11] This strategy is an example of a heuristic: a reasoning shortcut that is imperfect but easy to compute.[63] Klayman and Ha used Bayesian probability and information theory as their standard of hypothesis-testing, rather than the falsificationism used by Wason. According to these ideas, each answer to a question yields a different amount of information, which depends on the person’s prior beliefs. Thus a scientific test of a hypothesis is one that is expected to produce the most information. Since the information content depends on initial probabilities, a positive test can either be highly informative or uninformative. Klayman and Ha argued that when people think about realistic problems, they are looking for a specific answer with a small initial probability. In this case, positive tests are usually more informative than negative tests.[16] However, in Wason’s rule discovery task the answer—three numbers in ascending order—is very broad, so positive tests are unlikely to yield informative answers. Klayman and Ha supported their analysis by citing an experiment that used the labels «DAX» and «MED» in place of «fits the rule» and «doesn’t fit the rule». This avoided implying that the aim was to find a low-probability rule. Participants had much more success with this version of the experiment.[64][65]

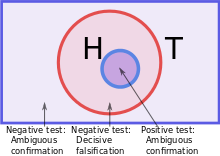

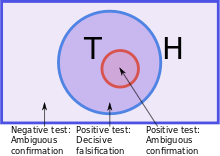

|

If the true rule (T) encompasses the current hypothesis (H), then positive tests (examining an H to see if it is T) will not show that the hypothesis is false. |

If the true rule (T) overlaps the current hypothesis (H), then either a negative test or a positive test can potentially falsify H. |

When the working hypothesis (H) includes the true rule (T) then positive tests are the only way to falsify H. |

In light of this and other critiques, the focus of research moved away from confirmation versus falsification of an hypothesis, to examining whether people test hypotheses in an informative way, or an uninformative but positive way. The search for «true» confirmation bias led psychologists to look at a wider range of effects in how people process information.[66]

Information processing explanations[edit]

There are currently three main information processing explanations of confirmation bias, plus a recent addition.

Cognitive versus motivational[edit]

Happy events are more likely to be remembered.

According to Robert MacCoun, most biased evidence processing occurs through a combination of «cold» (cognitive) and «hot» (motivated) mechanisms.[67]

Cognitive explanations for confirmation bias are based on limitations in people’s ability to handle complex tasks, and the shortcuts, called heuristics, that they use.[68] For example, people may judge the reliability of evidence by using the availability heuristic that is, how readily a particular idea comes to mind.[69] It is also possible that people can only focus on one thought at a time, so find it difficult to test alternative hypotheses in parallel.[1]: 198–199 Another heuristic is the positive test strategy identified by Klayman and Ha, in which people test a hypothesis by examining cases where they expect a property or event to occur. This heuristic avoids the difficult or impossible task of working out how diagnostic each possible question will be. However, it is not universally reliable, so people can overlook challenges to their existing beliefs.[16][1]: 200

Motivational explanations involve an effect of desire on belief.[1]: 197 [70] It is known that people prefer positive thoughts over negative ones in a number of ways: this is called the «Pollyanna principle».[71] Applied to arguments or sources of evidence, this could explain why desired conclusions are more likely to be believed true. According to experiments that manipulate the desirability of the conclusion, people demand a high standard of evidence for unpalatable ideas and a low standard for preferred ideas. In other words, they ask, «Can I believe this?» for some suggestions and, «Must I believe this?» for others.[72][73] Although consistency is a desirable feature of attitudes, an excessive drive for consistency is another potential source of bias because it may prevent people from neutrally evaluating new, surprising information. Social psychologist Ziva Kunda combines the cognitive and motivational theories, arguing that motivation creates the bias, but cognitive factors determine the size of the effect.[1]: 198

Cost-benefit[edit]