Корректирующие коды «на пальцах»

Время на прочтение

11 мин

Количество просмотров 63K

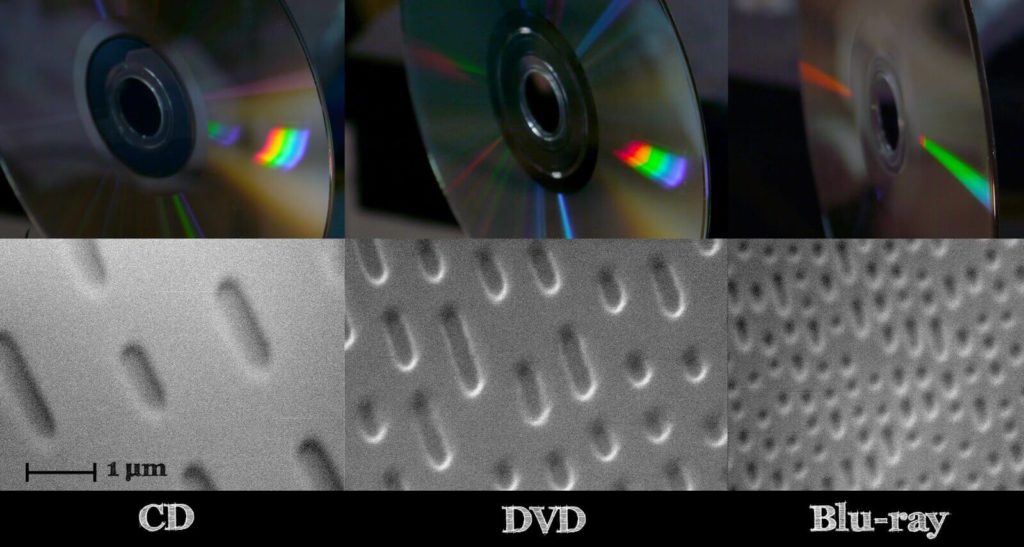

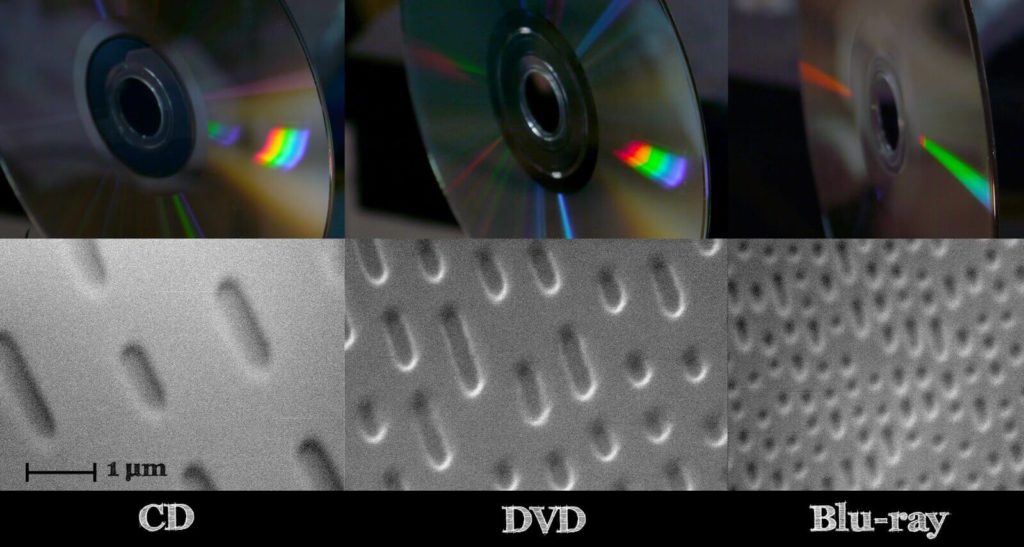

Корректирующие (или помехоустойчивые) коды — это коды, которые могут обнаружить и, если повезёт, исправить ошибки, возникшие при передаче данных. Даже если вы ничего не слышали о них, то наверняка встречали аббревиатуру CRC в списке файлов в ZIP-архиве или даже надпись ECC на планке памяти. А кто-то, может быть, задумывался, как так получается, что если поцарапать DVD-диск, то данные всё равно считываются без ошибок. Конечно, если царапина не в сантиметр толщиной и не разрезала диск пополам.

Корректирующие (или помехоустойчивые) коды — это коды, которые могут обнаружить и, если повезёт, исправить ошибки, возникшие при передаче данных. Даже если вы ничего не слышали о них, то наверняка встречали аббревиатуру CRC в списке файлов в ZIP-архиве или даже надпись ECC на планке памяти. А кто-то, может быть, задумывался, как так получается, что если поцарапать DVD-диск, то данные всё равно считываются без ошибок. Конечно, если царапина не в сантиметр толщиной и не разрезала диск пополам.

Как нетрудно догадаться, ко всему этому причастны корректирующие коды. Собственно, ECC так и расшифровывается — «error-correcting code», то есть «код, исправляющий ошибки». А CRC — это один из алгоритмов, обнаруживающих ошибки в данных. Исправить он их не может, но часто это и не требуется.

Давайте же разберёмся, что это такое.

Для понимания статьи не нужны никакие специальные знания. Достаточно лишь понимать, что такое вектор и матрица, как они перемножаются и как с их помощью записать систему линейных уравнений.

Внимание! Много текста и мало картинок. Я постарался всё объяснить, но без карандаша и бумаги текст может показаться немного запутанным.

Каналы с ошибкой

Разберёмся сперва, откуда вообще берутся ошибки, которые мы собираемся исправлять. Перед нами стоит следующая задача. Нужно передать несколько блоков данных, каждый из которых кодируется цепочкой двоичных цифр. Получившаяся последовательность нулей и единиц передаётся через канал связи. Но так сложилось, что реальные каналы связи часто подвержены ошибкам. Вообще говоря, ошибки могут быть разных видов — может появиться лишняя цифра или какая-то пропасть. Но мы будем рассматривать только ситуации, когда в канале возможны лишь замены нуля на единицу и наоборот. Причём опять же для простоты будем считать такие замены равновероятными.

Ошибка — это маловероятное событие (а иначе зачем нам такой канал вообще, где одни ошибки?), а значит, вероятность двух ошибок меньше, а трёх уже совсем мала. Мы можем выбрать для себя некоторую приемлемую величину вероятности, очертив границу «это уж точно невозможно». Это позволит нам сказать, что в канале возможно не более, чем ошибок. Это будет характеристикой канала связи.

Для простоты введём следующие обозначения. Пусть данные, которые мы хотим передавать, — это двоичные последовательности фиксированной длины. Чтобы не запутаться в нулях и единицах, будем иногда обозначать их заглавными латинскими буквами (,

,

, …). Что именно передавать, в общем-то неважно, просто с буквами в первое время будет проще работать.

Кодирование и декодирование будем обозначать прямой стрелкой (), а передачу по каналу связи — волнистой стрелкой (

). Ошибки при передаче будем подчёркивать.

Например, пусть мы хотим передавать только сообщения и

. В простейшем случае их можно закодировать нулём и единицей (сюрприз!):

Передача по каналу, в котором возникла ошибка будет записана так:

Цепочки нулей и единиц, которыми мы кодируем буквы, будем называть кодовыми словами. В данном простом случае кодовые слова — это и

.

Код с утроением

Давайте попробуем построить какой-то корректирующий код. Что мы обычно делаем, когда кто-то нас не расслышал? Повторяем дважды:

Правда, это нам не очень поможет. В самом деле, рассмотрим канал с одной возможной ошибкой:

Какие выводы мы можем сделать, когда получили ? Понятно, что раз у нас не две одинаковые цифры, то была ошибка, но вот в каком разряде? Может, в первом, и была передана буква

. А может, во втором, и была передана

.

То есть, получившийся код обнаруживает, но не исправляет ошибки. Ну, тоже неплохо, в общем-то. Но мы пойдём дальше и будем теперь утраивать цифры.

Проверим в деле:

Получили . Тут у нас есть две возможности: либо это

и было две ошибки (в крайних цифрах), либо это

и была одна ошибка. Вообще, вероятность одной ошибки выше вероятности двух ошибок, так что самым правдоподобным будет предположение о том, что передавалась именно буква

. Хотя правдоподобное — не значит истинное, поэтому рядом и стоит вопросительный знак.

Если в канале связи возможна максимум одна ошибка, то первое предположение о двух ошибках становится невозможным и остаётся только один вариант — передавалась буква .

Про такой код говорят, что он исправляет одну ошибку. Две он тоже обнаружит, но исправит уже неверно.

Это, конечно, самый простой код. Кодировать легко, да и декодировать тоже. Ноликов больше — значит передавался ноль, единичек — значит единица.

Если немного подумать, то можно предложить код исправляющий две ошибки. Это будет код, в котором мы повторяем одиночный бит 5 раз.

Расстояния между кодами

Рассмотрим поподробнее код с утроением. Итак, мы получили работающий код, который исправляет одиночную ошибку. Но за всё хорошее надо платить: он кодирует один бит тремя. Не очень-то и эффективно.

И вообще, почему этот код работает? Почему нужно именно утраивать для устранения одной ошибки? Наверняка это всё неспроста.

Давайте подумаем, как этот код работает. Интуитивно всё понятно. Нолики и единички — это две непохожие последовательности. Так как они достаточно длинные, то одиночная ошибка не сильно портит их вид.

Пусть мы передавали , а получили

. Видно, что эта цепочка больше похожа на исходные

, чем на

. А так как других кодовых слов у нас нет, то и выбор очевиден.

Но что значит «больше похоже»? А всё просто! Чем больше символов у двух цепочек совпадает, тем больше их схожесть. Если почти все символы отличаются, то цепочки «далеки» друг от друга.

Можно ввести некоторую величину , равную количеству различающихся цифр в соответствующих разрядах цепочек

и

. Эту величину называют расстоянием Хэмминга. Чем больше это расстояние, тем меньше похожи две цепочки.

Например, , так как все цифры в соответствующих позициях равны, а вот

.

Расстояние Хэмминга называют расстоянием неспроста. Ведь в самом деле, что такое расстояние? Это какая-то характеристика, указывающая на близость двух точек, и для которой верны утверждения:

- Расстояние между точками неотрицательно и равно нулю только, если точки совпадают.

- Расстояние в обе стороны одинаково.

- Путь через третью точку не короче, чем прямой путь.

Достаточно разумные требования.

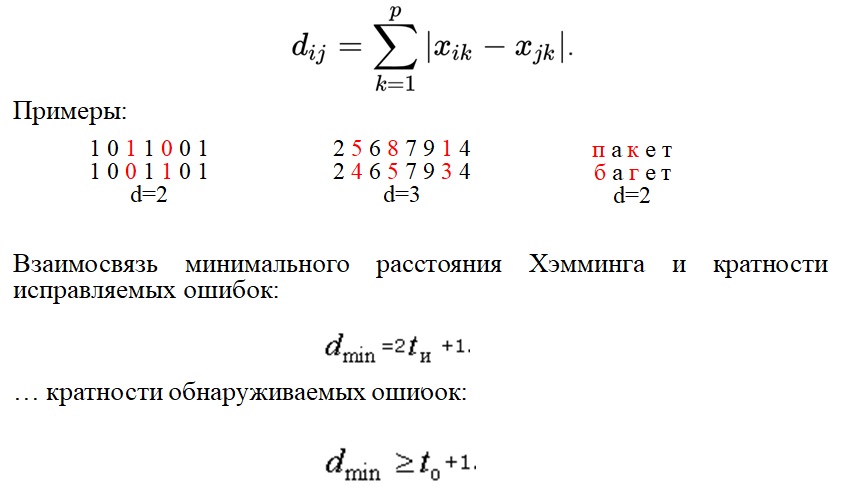

Математически это можно записать так (нам это не пригодится, просто ради интереса посмотрим):

.

Предлагаю читателю самому убедиться, что для расстояния Хэмминга эти свойства выполняются.

Окрестности

Таким образом, разные цепочки мы считаем точками в каком-то воображаемом пространстве, и теперь мы умеем находить расстояния между ними. Правда, если попытаться сколько нибудь длинные цепочки расставить на листе бумаги так, чтобы расстояния Хэмминга совпадали с расстояниями на плоскости, мы можем потерпеть неудачу. Но не нужно переживать. Всё же это особое пространство со своими законами. А слова вроде «расстояния» лишь помогают нам рассуждать.

Пойдём дальше. Раз мы заговорили о расстоянии, то можно ввести такое понятие как окрестность. Как известно, окрестность какой-то точки — это шар определённого радиуса с центром в ней. Шар? Какие ещё шары! Мы же о кодах говорим.

Но всё просто. Ведь что такое шар? Это множество всех точек, которые находятся от данной не дальше, чем некоторое расстояние, называемое радиусом. Точки у нас есть, расстояние у нас есть, теперь есть и шары.

Так, скажем, окрестность кодового слова радиуса 1 — это все коды, находящиеся на расстоянии не больше, чем 1 от него, то есть отличающиеся не больше, чем в одном разряде. То есть это коды:

Да, вот так странно выглядят шары в пространстве кодов.

А теперь посмотрите. Это же все возможные коды, которые мы получим в канале в одной ошибкой, если отправим ! Это следует прямо из определения окрестности. Ведь каждая ошибка заставляет цепочку измениться только в одном разряде, а значит удаляет её на расстояние 1 от исходного сообщения.

Аналогично, если в канале возможны две ошибки, то отправив некоторое сообщение , мы получим один из кодов, который принадлежит окрестности

радиусом 2.

Тогда всю нашу систему декодирования можно построить так. Мы получаем какую-то цепочку нулей и единиц (точку в нашей новой терминологии) и смотрим, в окрестность какого кодового слова она попадает.

Сколько ошибок может исправить код?

Чтобы код мог исправлять больше ошибок, окрестности должны быть как можно шире. С другой стороны, они не должны пересекаться. Иначе если точка попадёт в область пересечения, непонятно будет, к какой окрестности её отнести.

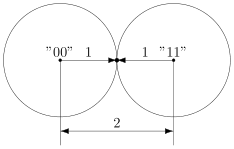

В коде с удвоением между кодовыми словами и

расстояние равно 2 (оба разряда различаются). А значит, если мы построим вокруг них шары радиуса 1, то они будут касаться. Это значит, точка касания будет принадлежать обоим шарам и непонятно будет, к какому из них её отнести.

Именно это мы и получали. Мы видели, что есть ошибка, но не могли её исправить.

Что интересно, точек касания в нашем странном пространстве у шаров две — это коды и

. Расстояния от них до центров равны единице. Конечно же, в обычно геометрии такое невозможно, поэтому рисунки — это просто условность для более удобного рассуждения.

В случае кода с утроением, между шарами будет зазор.

Минимальный зазор между шарами равен 1, так как у нас расстояния всегда целые (ну не могут же две цепочки отличаться в полутора разрядах).

В общем случае получаем следующее.

Этот очевидный результат на самом деле очень важен. Он означает, что код с минимальным кодовым расстоянием будет успешно работать в канале с

ошибками, если выполняется соотношение

Полученное равенство позволяет легко определить, сколько ошибок будет исправлять тот или иной код. А сколько код ошибок может обнаружить? Рассуждения такие же. Код обнаруживает ошибок, если в результате не получится другое кодовое слово. То есть, кодовые слова не должны находиться в окрестностях радиуса

других кодовых слов. Математически это записывается так:

Рассмотрим пример. Пусть мы кодируем 4 буквы следующим образом.

Чтобы найти минимальное расстояние между различными кодовыми словами, построим таблицу попарных расстояний.

| A | B | C | D | |

|---|---|---|---|---|

| A | — | 3 | 3 | 4 |

| B | 3 | — | 4 | 3 |

| C | 3 | 4 | — | 3 |

| D | 4 | 3 | 3 | — |

Минимальное расстояние , а значит

, откуда получаем, что такой код может исправить до

ошибок. Обнаруживает же он две ошибки.

Рассмотрим пример:

Чтобы декодировать полученное сообщение, посмотрим, к какому символу оно ближе всего.

Минимальное расстояние получилось для символа , значит вероятнее всего передавался именно он:

Итак, этот код исправляет одну ошибку, как и код с утроением. Но он более эффективен, так как в отличие от кода с утроением здесь кодируется уже 4 символа.

Таким образом, основная проблема при построении такого рода кодов — так расположить кодовые слова, чтобы они были как можно дальше друг от друга, и их было побольше.

Для декодирования можно было бы использовать таблицу, в которой указывались бы все возможные принимаемые сообщения, и кодовые слова, которым они соответствуют. Но такая таблица получилась бы очень большой. Даже для нашего маленького кода, который выдаёт 5 двоичных цифр, получилось бы варианта возможных принимаемых сообщений. Для более сложных кодов таблица будет значительно больше.

Попробуем придумать способ коррекции сообщения без таблиц. Мы всегда сможем найти полезное применение освободившейся памяти.

Интерлюдия: поле GF(2)

Для изложения дальнейшего материала нам потребуются матрицы. А при умножении матриц, как известно мы складываем и перемножаем числа. И тут есть проблема. Если с умножением всё более-менее хорошо, то как быть со сложением? Из-за того, что мы работаем только с одиночными двоичными цифрами, непонятно, как сложить 1 и 1, чтобы снова получилась одна двоичная цифра. Значит вместо классического сложения нужно использовать какое-то другое.

Введём операцию сложения как сложение по модулю 2 (хорошо известный программистам XOR):

Умножение будем выполнять как обычно. Эти операции на самом деле введены не абы как, а чтобы получилась система, которая в математике называется полем. Поле — это просто множество (в нашем случае из 0 и 1), на котором так определены сложение и умножение, чтобы основные алгебраические законы сохранялись. Например, чтобы основные идеи, касающиеся матриц и систем уравнений по-прежнему были верны. А вычитание и деление мы можем ввести как обратные операции.

Множество из двух элементов с операциями, введёнными так, как мы это сделали, называется полем Галуа GF(2). GF — это Galois field, а 2 — количество элементов.

У сложения есть несколько очень полезных свойств, которыми мы будем пользоваться в дальнейшем.

Это свойство прямо следует из определения.

А в этом можно убедиться, прибавив к обеим частям равенства. Это свойство, в частности означает, что мы можем переносить в уравнении слагаемые в другую сторону без смены знака.

Проверяем корректность

Вернёмся к коду с утроением.

Для начала просто решим задачу проверки, были ли вообще ошибки при передаче. Как видно, из самого кода, принятое сообщение будет кодовым словом только тогда, когда все три цифры равны между собой.

Пусть мы приняли вектор-строку из трёх цифр. (Стрелочки над векторами рисовать не будем, так как у нас почти всё — это вектора или матрицы.)

Математически равенство всех трёх цифр можно записать как систему:

Или, если воспользоваться свойствами сложения в GF(2), получаем

Или

В матричном виде эта система будет иметь вид

где

Транспонирование здесь нужно потому, что — это вектор-строка, а не вектор-столбец. Иначе мы не могли бы умножать его справа на матрицу.

Будем называть матрицу проверочной матрицей. Если полученное сообщение — это корректное кодовое слово (то есть, ошибки при передаче не было), то произведение проверочной матрицы на это сообщение будет равно нулевому вектору.

Умножение на матрицу — это гораздо более эффективно, чем поиск в таблице, но у нас на самом деле есть ещё одна таблица — это таблица кодирования. Попробуем от неё избавиться.

Кодирование

Итак, у нас есть система для проверки

Её решения — это кодовые слова. Собственно, мы систему и строили на основе кодовых слов. Попробуем теперь решить обратную задачу. По системе (или, что то же самое, по матрице ) найдём кодовые слова.

Правда, для нашей системы мы уже знаем ответ, поэтому, чтобы было интересно, возьмём другую матрицу:

Соответствующая система имеет вид:

Чтобы найти кодовые слова соответствующего кода нужно её решить.

В силу линейности сумма двух решений системы тоже будет решением системы. Это легко доказать. Если и

— решения системы, то для их суммы верно

что означает, что она тоже — решение.

Поэтому если мы найдём все линейно независимые решения, то с их помощью можно получить вообще все решения системы. Для этого просто нужно найти их всевозможные суммы.

Выразим сперва все зависимые слагаемые. Их столько же, сколько и уравнений. Выражать надо так, чтобы справа были только независимые. Проще всего выразить .

Если бы нам не так повезло с системой, то нужно было бы складывая уравнения между собой получить такую систему, чтобы какие-то три переменные встречались по одному разу. Ну, или воспользоваться методом Гаусса. Для GF(2) он тоже работает.

Итак, получаем:

Чтобы получить все линейно независимые решения, приравниваем каждую из зависимых переменных к единице по очереди.

Всевозможные суммы этих независимых решений (а именно они и будут кодовыми векторами) можно получить так:

где равны либо нулю или единице. Так как таких коэффициентов два, то всего возможно

сочетания.

Но посмотрите! Формула, которую мы только что получили — это же снова умножение матрицы на вектор.

Строчки здесь — линейно независимые решения, которые мы получили. Матрица называется порождающей. Теперь вместо того, чтобы сами составлять таблицу кодирования, мы можем получать кодовые слова простым умножением на матрицу:

Найдём кодовые слова для этого кода. (Не забываем, что длина исходных сообщений должна быть равна 2 — это количество найденных решений.)

Итак, у нас есть готовый код, обнаруживающий ошибки. Проверим его в деле. Пусть мы хотим отправить 01 и у нас произошла ошибка при передаче. Обнаружит ли её код?

А раз в результате не нулевой вектор, значит код заподозрил неладное. Провести его не удалось. Ура, код работает!

Для кода с утроением, кстати, порождающая матрица выглядит очень просто:

Подобные коды, которые можно порождать и проверять матрицей называются линейными (бывают и нелинейные), и они очень широко применяются на практике. Реализовать их довольно легко, так как тут требуется только умножение на константную матрицу.

Ошибка по синдрому

Ну хорошо, мы построили код обнаруживающий ошибки. Но мы же хотим их исправлять!

Для начала введём такое понятие, как вектор ошибки. Это вектор, на который отличается принятое сообщение от кодового слова. Пусть мы получили сообщение , а было отправлено кодовое слово

. Тогда вектор ошибки по определению

Но в странном мире GF(2), где сложение и вычитание одинаковы, будут верны и соотношения:

В силу особенностей сложения, как читатель сам может легко убедиться, в векторе ошибки на позициях, где произошла ошибка будет единица, а на остальных ноль.

Как мы уже говорили раньше, если мы получили сообщение с ошибкой, то

. Но ведь векторов, не равных нулю много! Быть может то, какой именно ненулевой вектор мы получили, подскажет нам характер ошибки?

Назовём результат умножения на проверочную матрицу синдромом:

И заметим следующее

Это означает, что для ошибки синдром будет таким же, как и для полученного сообщения.

Разложим все возможные сообщения, которые мы можем получить из канала связи, по кучкам в зависимости от синдрома. Тогда из последнего соотношения следует, что в каждой кучке будут вектора с одной и той же ошибкой. Причём вектор этой ошибки тоже будет в кучке. Вот только как его узнать?

А очень просто! Помните, мы говорили, что у нескольких ошибок вероятность ниже, чем у одной ошибки? Руководствуясь этим соображением, наиболее правдоподобным будет считать вектором ошибки тот вектор, у которого меньше всего единиц. Будем называть его лидером.

Давайте посмотрим, какие синдромы дают всевозможные 5-элементные векторы. Сразу сгруппируем их и подчеркнём лидеров — векторы с наименьшим числом единиц.

В принципе, для корректирования ошибки достаточно было бы хранить таблицу соответствия синдрома лидеру.

Обратите внимание, что в некоторых строчках два лидера. Это значит для для данного синдрома два паттерна ошибки равновероятны. Иными словами, код обнаружил две ошибки, но исправить их не может.

Лидеры для всех возможных одиночных ошибок находятся в отдельных строках, а значит код может исправить любую одиночную ошибку. Ну, что же… Попробуем в этом убедиться.

Вектор ошибки равен , а значит ошибка в третьем разряде. Как мы и загадали.

Ура, всё работает!

Что же дальше?

Чтобы попрактиковаться, попробуйте повторить рассуждения для разных проверочных матриц. Например, для кода с утроением.

Логическим продолжением изложенного был бы рассказ о циклических кодах — чрезвычайно интересном подклассе линейных кодов, обладающим замечательными свойствами. Но тогда, боюсь, статья уж очень бы разрослась.

Если вас заинтересовали подробности, то можете почитать замечательную книжку Аршинова и Садовского «Коды и математика». Там изложено гораздо больше, чем представлено в этой статье. Если интересует математика кодирования — то поищите «Теория и практика кодов, контролирующих ошибки» Блейхута. А вообще, материалов по этой теме довольно много.

Надеюсь, когда снова будет свободное время, напишу продолжение, в котором расскажу про циклические коды и покажу пример программы для кодирования и декодирования. Если, конечно, почтенной публике это интересно.

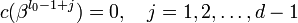

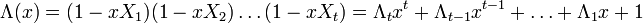

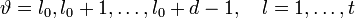

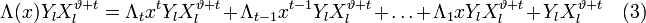

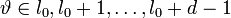

Коды

Боуза—Чоудхури—Хоквингема

(БЧХ-коды)

представляют собой большой класс

циклических кодов, исправляющих

независимые

ошибки кратности t

и

менее.

Для кодов БЧХ характерны

все основные свойства циклических

кодов. Чаще всего

коды БЧХ описывают с помощью корней

порождающего многочлена

Р

(х) степени

2t.

В качестве корней Р

(х) выбирают

2t

последовательных

элементов аj,aj+1

…, аj+2i-1поля

Галуа GF

(р’п),

где

1≤ j≤pm—

1. Если при этом элемент а

является примитивным

(первообразным) в поле GF(pm),

то

такой код БЧХ

называют примитивным с длиной кодовой

комбинации п=рт—1

над полем GF

(р). Для

двоичных примитивных кодов

БЧХ п

=

2n

— 1 над полем GF

(2).

В случае, если ряд корней

многочлена Р(х)

для

кода БЧХ начинается с j=1,

т. е. а,

а2,

…. а2t,

то

такой код называют кодом БЧХ в узком

смысле.

Код

БЧХ, у которого корень

а

не является примитивным элементом

поля GF

(рm),

т.

е. имеет

порядок

d

<

рт

—1,

называют

непримитивным

с

длиной

комбинации

п

=d.

Пусть

аj—элемент

расширения

простого числового поля. Тогда по

определению, данному в [7], некоторый

нормированный

многочлен

т(х)

наименьшей

степени, для

которого т(аj

)

=

0, называют минимальной

функцией

для аi.

Отметим,

что

минимальные

функции m(х)

являются

непри-водимыми

многочленами.

Если предположить, что каждому из корней

аi

производящего

многочлена Р

(х) соответствует

своя минимальная

функция

тi

(х), то

производящий многочлен Р

(х) должен

быть наименьшим общим

кратным

всех

минимальных

функций,

т. е.

P(x)=НОК[m1(x),m2(x),

…

m2t(x)]. (51)

Таким

образом,

вектор,

представленный многочленом

f

(x),будет

кодовым тогда и только тогда, когда он

делится без остатка

как на каждую из минимальных функций

т1

(х), m2(x),

…, т2t

(х), так

и на их наименьшее общее кратное.

Тогда

для любого из корней а, а2,

….a2t

справедливо уравнение

f

(аi)

=

с0

+ с1

аi

+с2(аi

)2+…cn-1

(ai)n-1

= 0, которое

можно записать в виде произведения двух

матриц (coc1c2…cn-1)*[lai(ai)2…(ai)n-1]T=0.

Но

так как корнями

f(х)

должны

быть все элементы a,

a2

…,a2t,

то можно

сделать вывод, что вектор (c0c1…cn-1_)

будет

кодовым тогда

и только тогда, когда он принадлежит

нулевому пространству

матрицы

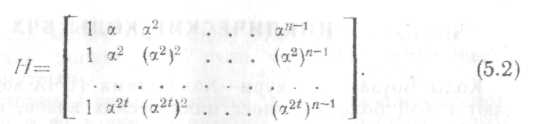

Может

оказаться, что элементы аi

и аj

из совокупности а, а2,

…, а2t

соответствуют одной и той же минимальной

функции,

т. е. тi

(х) = mj(х).

Вследствие

того, что производящий многочлен

Р(х) равен

наименьшему общему кратному всех

минимальных

функций mj(х),

в качестве

сомножителя в разложении многочлена

Р(х) следует

взять только одну из нескольких равных

между собой минимальных функций.

Из

свойства 1.6 полей следует, что если аi

корень

какой-либо

минимальной неприводимой по модулю 2

функции mi

(х)степени

к,

то

остальными корнями будут

(аi)2,((аi)2)2,…,(ai)2^(k-1).Следовательно,

в разложении многочлена Р

(х) каждая

из

различных минимальных функций mi

(х)

должна

входить

только один раз, а для построения матрицы

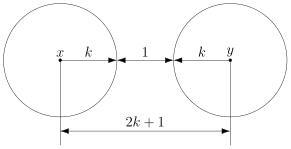

(5.2) нужно использовать

только по одному корню каждой из

минимальных функций,

входящих в разложение многочлена Р

(х). Таким

образом,

если в качестве совокупности корней

многочлена Р

(х) выбраны

элементы поля Галуа GF

(2m)

а, а2,

а3,

…, а2t,

то при

построении матрицы Н

должны

быть использованы только нечетные

степени а, а3,

…, а2t-1,

а многочлен Р

(х) будет

иметь

вид

P(x)=m1(x)m3(x)

… m2t-1(x). (5.3)

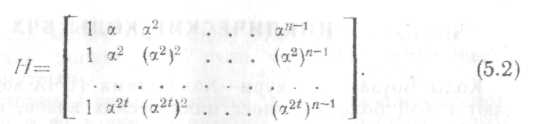

Рассмотрим

следующий пример.

Пример

5.1. Пусть

имеем двоичный циклический код БЧХ. к

которому

вектор {f

(х)}

будет

принадлежать только тогда, когда элементы

а, a2,

а3,

а4,

а5,

а6

будут корнями многочлена f

(х). Кроме

того, предполагается, что a

— примитивный элемент

поля Галуа GF

(24).

Тогда а15

= 1 и тi

(х) обозначает

минимальную

функцию для аj

.

В

соответствие со свойством 1.6 элементы

a,

а2,

а4

и а8

— корни

одной

и той же минимальной функции четвертой

степени,

следовательно, m1(х)

=

т2

(х)= т4

(х) =

т8

(х). Аналогично,

а3,

а6,

а12

и

а24

= а9

— корни минимальной функции четвертой

степени и m3

(х) = т6

(х) =

m9

(х) = т12(х),

а

элементы

a5

и а10

являются корнями минимальной функции

второй степени

и, следовательно, т5

(х)=т10(х).

Отсюда,

Р

(х) является

многочленом

P(x)=

ml(x)m3(x)m5(x)

(5.4)

степень

которого равна 10.

Таким

образом, к искомому циклическому коду

БЧХ будет принадлежать

любой вектор {f

(х)},

если

f

(х) делится

на Р(х).

В

то же время циклический код будет нулевым

пространством матрицы

Так

как аj

является элементом поля GF

(2т

)

и представляет собой

вектор из т

двоичных

элементов 0 и I,

то матрица HT

имеет

размерность

п

*

mt.

Из

свойства 2.2 следует, что многочлен Р

(х) является

делителем

многочлена F

(х) = хn

—

1, где п

=

2m—1.

В то же время,

многочлен Р

(х) для

кодов БЧХ равен произведению минимальных

функций. Следовательно, любая из

минимальных функций,

входящих в разложение многочлена

Р(х),

должна

быть

делителем функции F

(х) =

хn—

1 = х2^m-1—

1. При этом, как

следует из высшей алгебры [4, 7], степень

каждой минимальной

функции не может быть больше т.

А

так как таких функций

t,

то

степень многочлена Р

(х) не

превосходит mt.

Отсюда

каждая комбинация циклического

примитивного кода

БЧХ при длине, равной n

= 2m—1,

имеет число информационных

разрядов, равное k≥2m—

1—mt.

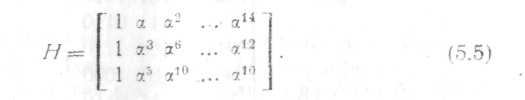

Рассмотрим

конкретный пример построения циклического

кода

БЧХ.

Пример

5.2.

Построить двоичный примитивный

циклический код

БЧХ для т

=

4 и t=

3.

В

этом случае длина кодовой комбинации

равна п

=

2m—

1 = 15, а вектор {f

(х)}

будет

принадлежать этому циклическому

коду, если элементы поля GF

(24)

а, a2,

…, а6

будут корнями

многочлена f(х).

Кроме

того, отметим, что а — примитивный

элемент поля, а минимальной функцией

для него пусть

будет примитивный неприводимый

многочлен т1

(х) =

1 +x+x4.

Как

видим, этот пример является непосредственным

продолжением

примера 5.1, из которого следует, что

производящий многочлен

Р

(х) имеет

вид Р

(х) =

m1(х)

т3

(х) т5

(х), где

т1

(х) и

m3

(х)

—

минимальные многочлены четвертой

степени, а

т5

(х) —

минимальный многочлен второй степени,

вследствие чего

степень

многочлена Р

(х) равна

10. Кроме того, было показано,

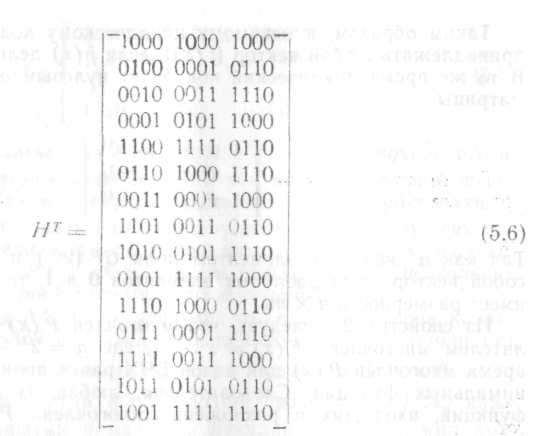

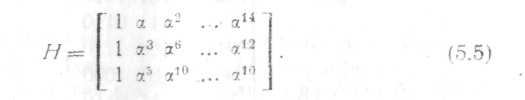

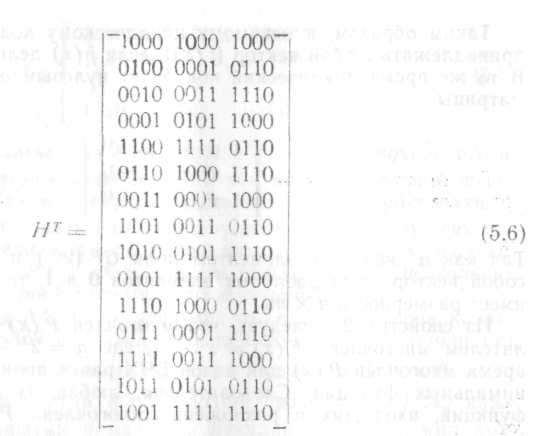

что матрица Н

имеет

вид (5.5).

Т

ак

как примитивный элемент а — корень

минимального многочлена тх(х)=1

+ х

+

х4,

то,

подставив вместо каждого элемента

матрицы H

его

значение из табл. 1.1,

получим транспонированную

матрицу НТ;

В [7] показано, что

m3(x)=1+x+x2+x3+x4,

m5(x)=1+x+x2,

тогда степень многочлена P(x)

равна 10, что не превышает mt.

В рассмотренном

примере

![]()

Т

огда

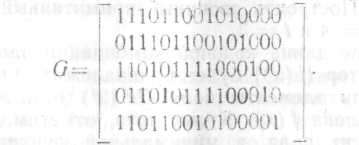

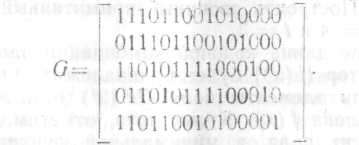

производящая матрица G

искомого систематического кода

имеет вид :

Образованный таким

образом циклический (n,k)=(15,5)

код БЧХ позволяет исправить любую

совокупность ошибок кратности t=3

и менее.

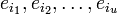

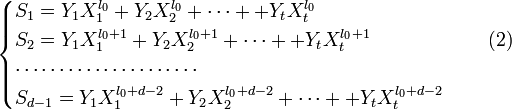

Принципы

исправления ошибок кодами БЧХ

Предположим, что

передавая кодовый вектор {f(x)},

представление которого в виде многочлена

будет иметь вид: f(x)=c0+c1x+…+cn-1xn-1.

Пусть далее вследствие ошибок вместо

вектора {f(x)}

принят вектор {f(x)+e(x)}=

{f(x)}+

{e(x)},

где {e(x)}-вектор

ошибок.

Обозначим принятый

с ошибками вектор {f(x)+e(x)}

через вектор {h(x)}=(h0h1h2…hn-1).Принятую

комбинацию можно представить в виде

многочлена степени n-1,

т.е. h(x)=h0+h1x+h2x2+…+hn-1xn-1.

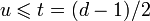

В результате умножения вектора {h(x)}

на матрицу (5.2) получим вектор из t

компонент [h(a),

h(a3),…h(a2t-1)],где

h(a)=h0+h1a+h2a2+…+hn-1an-1;

h(a3)=h0+h1a3+h2(a3)2+…+hn-1(a3)n-1

И т.д.

В то же время

{h(x)}=

{f(x)+e(x)},

следовательно, h(x)=

f(x)+e(x).

Тогда h(ai)=f(ai)+e(ai),

где i=1,3,…,2t-1,

но так как f(x)

делится на P(x)

без остатка, то f(a)=f(a3)=…=f(a2t-1)≡0,

так что h(ai)≡e(ai).

![]()

При умножении

вектора {h(x)}

на первый столбец матрицы HT

, образованной из (5.5), получаем элемент

![]()

Отсюда следует,

что имеется взаимнооднозначное

соответствие между элементами вектора

ошибок и элементами поля GF(2m).

Каждому ошибочному элементу ei

соответствует элемент i-й

строки (i=0,1,2,…,n-1)

первого столбца транспонированной

матрицы HT,

т.е. элемент поля ai.

Предположим,

что ошибки произошли на позициях

i1,i2,…,it,

для которых ei=1,

а для всех остальных ej=0,

тогда (5.8) может быть переписана следующим

образом:

![]()

Обозначим

каждый из элементов аk

через Хk

(k

= 1, 2, …it)

и назовем

их локаторами ошибок, тогда (5.9) может

быть переписана

так:

Умножив

вектор {h(x)}

на

какой-либо другой j-й

столбец матрицы

HTполучим

h(aj)=e(aj)=(aj)i1+(aj)i2+…+(aj)it=

где j=

1, 3, ….

2t—

1.

Выражения

(5.11) представляют t

симметрических

функций

Sj

от

нечетных

степеней элементов Х1,

Х2 Xt,

которые

имеют вид

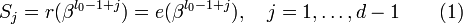

![]()

Функции

Sj

называют

синдромами.

Таким

образом, функции Sj

дают t

уравнений

вида (5.12) с t

неизвестными

Х1,

Х2…,

Xt.

Кроме

того, из (5.12) можно найти

также симметрические функции для четных

j

= 2, 4, .., 2t,

т. е. можно получить дополнительно t

уравнений

вида (5.12) с

теми же неизвестными. Действительно,

учитывая свойство 1.4 для

р

=

2, получим

![]()

Решение

указанных уравнений относительно Хk

определит

номера

ошибочных позиций. Поскольку имеется

конечное число решений,

то значения Хk

могут

быть найдены путем подстановок

в эти уравнения различных элементов

поля GF

(2m).

Но

подстановка

всех комбинаций no

t

из 2m

— 1

ненулевых элементов

поля требует большого числа вычислений.

Для

кодов БЧХ имеются более эффективные

алгебраические алгоритмы

декодирования. Рассмотрим один из них.

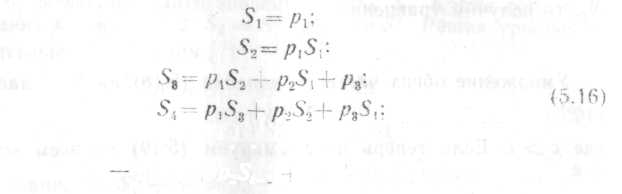

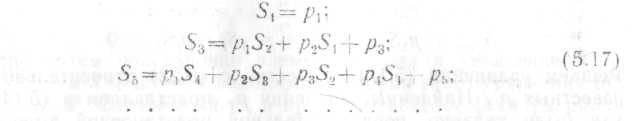

Так

как суммы j—x

степеней

элементов Х1,Х2,

...,

Xt

представляют

собой симметрические функции Sj,

то

эти элементы могут

рассматриваться

[8] как корни некоторого многочлена

степени

t

Xt+p1Xt-1+p2Xt-2+…+pt (5.I4)

разложение

которого на линейные множители дает

уравнение

(X-X1)(Х-Х2)

…

(X—Xt)=0. (5.16)

Коэффициенты

р1,

р2,

…,

рt

являются

простейшими

симметрическими

функциями,

которые связаны с симметрическими

функциями

Sj

тождествами

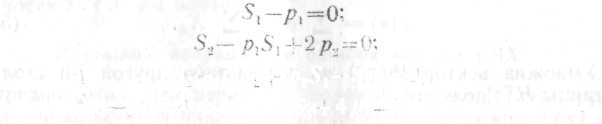

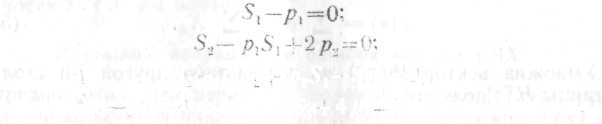

Ньютона [1, 7]:

S3-p1S2+p2S1-3p3=0

S4-p1S3+p2S2-p3S1+4p4=0

и

т.

д.

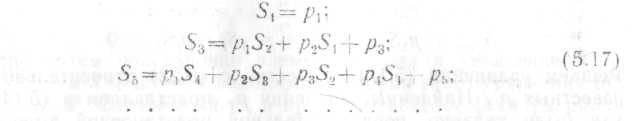

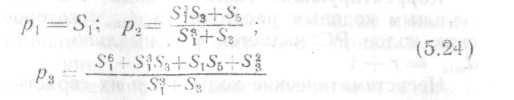

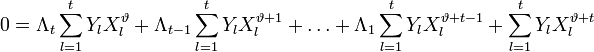

![]()

При

операциях по

модулю

2 тождества Ньютона выписываются по

формуле

где

δ = 0 при i—четном

и

δ=1-

при

нечетном.

С

учетом последнего тождества Ньютона

можно переписать

так:

St=p1St-1+p2St-2+…+pt-1S1+

δpt

Если

тождества (5.16) решить относительно

простейших симметрических

функций pi

и

найденные значения рi,

подставить

в

(5.14),

то корни этого многочлена Х1,

Х2,

…, Xt

можно

определить

последовательной подстановкой в него

каждого из п

=

2m

—

1 элементов поля. Если подставленный

вместо X

элемент

аi

не является корнем, то соответствующий

символ вектора {h

(x)}

принят

правильно. Если же элемент ai

является

корнем,

то соответствующий i-й

символ вектора {h

(х)} принят

ошибочным

и должен быть исправлен.

Однако

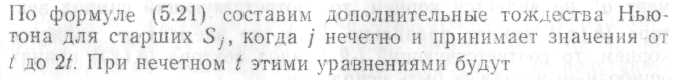

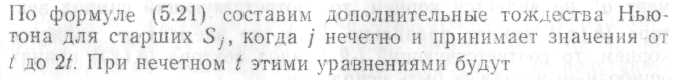

в силу зависимости (5.13) следует

рассматривать не

все тождества (5.16), а лишь те, которые

определяют Sj

для

нечетных

j,

т. е.

St-1=p1St-2+p2St-3+…+pt-2S1+pt-1

(при

t

—четном)

или

St=p1St-1+p2St-2+…pt-1S1+pt

(при

t—

нечетном).

Отсюда

видно, что имеется i/2

(при t—четном)

или (t+1)/2

(при

t

— нечетном) уравнений, которых

недостаточно для

определения t

неизвестных

р1,

р2,

…, рi.

Однако

в результате умножения {h(x)}*HT

можно

определить все симметрические

функции S1,

S3,…,S2t-1.

Знание симметрических функций

Sj

с

нечетными значениями j’

вплоть до 2t—1позволяет

составить

дополнительные уравнения, которые

вместе с (5.17)

дадут

t

независимых

уравнений с t

неизвестными

р1,р2,

….

рt

Эти

уравнения можно уже решить относительно

pt.

Выше

было показано, как составить тождества

Ньютона, когда

j

при Sj

принимает

целые значения, не превосходящие

t,

т.

е. степени многочлена (5.14).

Можно показать, что аналогично

можно составить тождества Ньютона для

значений j

> t.

Действительно,

если обозначить многочлен (5.14)

через ψ(X)

и

подставить

вместо X

какой-либо

из корней Х1,

X2

…. Xt,

то

получим уравнение

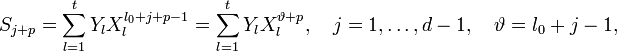

![]()

Умножение обоих

частей уравнения (5.18) на Xic—t

дает

![]()

Где c>t.

Если теперь просуммируем (5.19) по всем

корням, т.е.

![]()

То получим

![]()

Решаем

уравнения (5.17) совместно с (5.22) относительно

неизвестных

рi

Найденные

значения рi

подставляем

в (5.14) и, как

было указано, последовательной

подстановкой вместо X

элементов

поля GF

(2m)

находим корни этого многочлена. Этим

самым

мы устанавливаем ошибочные позиции

принятого вектора

{h

(х)}.

Если

произошло в действительности t

—

1 ошибок, то один из

корней Х1,

Х2,…Xt

должен

быть равен нулю. Следовательно,

при решении уравнений (5.17) и (5.22) мы должны

получить pt

=0.

Если произошло t

—

2 ошибки, то два корня равны

нулю и, следовательно, pt=

рt-1=

0

и так далее.

Пример

5.3. Рассмотрим

процесс исправления тройных ошибок

(t

=

3) циклическим кодом БЧХ, построение

которого рассматривалось

в примере 5.2. Многочлен (5.14) для такого

кода будет

иметь вид Х3

+

р1Х2

+

р2Х

+

р3

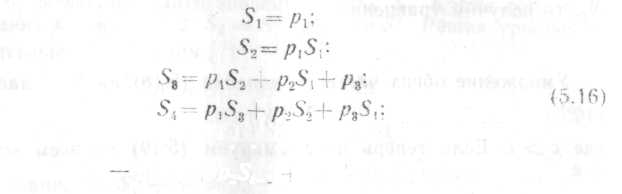

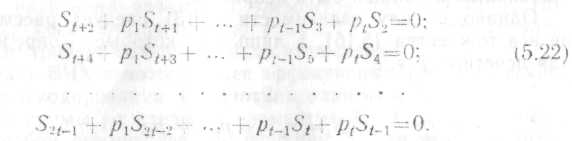

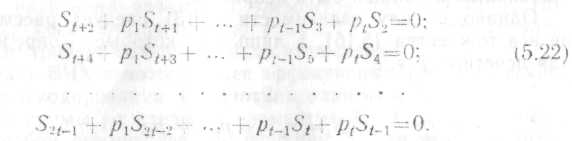

На основании (5.17)

и (5.22) составляем уравнения:

Сложение

по модулю 2 соответствующих столбцов

матрицы HT(5.6)

позволяет найти значения S1,S3,

S5.

Кроме

того, при операциях

по модулю 2 S2

= S12,

a

S4

= S14

Решая уравнения относительно

рt,

находим

[7]:

при условии, что

S13+S3≠0.

Рассмотрим случай,

когда ошибки появляются на 2, 5 и 7-м

местах, т.е. {e(x)}=(010010100000000),

тогда {h(x)}HT=(1011,1111,1000),

т.е. S1=(1011),

S3=(1111),

S5=(1000).

Теперь найдем S2

и S4,

обращаясь к табл. 1.1,

![]()

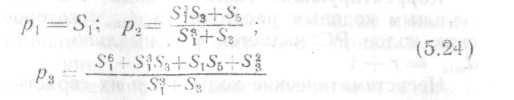

По формулам (5.24)

находим p1=S1=a13,

Теперь

путем подстановки элементов поля в

уравнение X3+

+

а13X2+

а9X

+a11=

0 находим, что корни этого уравнения

будут

а, а4

а6.

Следовательно, в принятом векторе {h

(x)}

ошибки

находятся

на 2, 5 и 7-м местах. Если произошла только

одна ошибка,

то р2

= р3

= 0, а из

уравнений (5.23) pi=S1.

Следовательно,

номер ошибочной позиции можно определить,

решая, уравнение

X

+р1=

0.

Содержание

- 1 Исправление ошибок в помехоустойчивом кодировании

- 2 Параметры помехоустойчивого кодирования

- 3 Контроль чётности

- 4 Классификация помехоустойчивых кодов

- 5 Код Хэмминга

- 5.1 Декодирование кода Хэмминга

- 5.2 Расстояние Хэмминга

- 6 Помехоустойчивые коды

- 6.1 Компромиссы при использовании помехоустойчивых кодов

- 6.2 Необходимость чередования (перемежения)

Назначение помехоустойчивого кодирования – защита информации от помех и ошибок при передаче и хранении информации. Помехоустойчивое кодирование необходимо для устранения ошибок, которые возникают в процессе передачи, хранения информации. При передачи информации по каналу связи возникают помехи, ошибки и небольшая часть информации теряется.

Без использования помехоустойчивого кодирования было бы невозможно передавать большие объемы информации (файлы), т.к. в любой системе передачи и хранении информации неизбежно возникают ошибки.

Рассмотрим пример CD диска. Там информация хранится прямо на поверхности диска, в углублениях, из-за того, что все дорожки на поверхности, часто диск хватаем пальцами, елозим по столу и из-за этого без помехоустойчивого кодирования, информацию извлечь не получится.

Использование кодирования позволяет извлекать информацию без потерь даже с поврежденного CD/DVD диска, когда какая либо область становится недоступной для считывания.

В зависимости от того, используется в системе обнаружение или исправление ошибок с помощью помехоустойчивого кода, различают следующие варианты:

- запрос повторной передачи (Automatic Repeat reQuest, ARQ): с помощью помехоустойчивого кода выполняется только обнаружение ошибок, при их наличии производится запрос на повторную передачу пакета данных;

- прямое исправление ошибок (Forward Error Correction, FEC): производится декодирование помехоустойчивого кода, т. е. исправление ошибок с его помощью.

Возможен также гибридный вариант, чтобы лишний раз не гонять информацию по каналу связи, например получили пакет информации, попробовали его исправить, и если не смогли исправить, тогда отправляется запрос на повторную передачу.

Исправление ошибок в помехоустойчивом кодировании

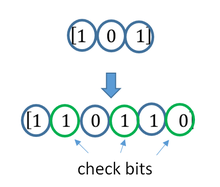

Любое помехоустойчивое кодирование добавляет избыточность, за счет чего и появляется возможность восстановить информацию при частичной потере данных в канале связи (носителе информации при хранении). В случае эффективного кодирования убирали избыточность, а в помехоустойчивом кодировании добавляется контролируемая избыточность.

Простейший пример – мажоритарный метод, он же многократная передача, в котором один символ передается многократно, а на приемной стороне принимается решение о том символе, количество которых больше.

Допустим есть 4 символа информации, А, B, С,D, и эту информацию повторяем несколько раз. В процессе передачи информации по каналу связи, где-то возникла ошибка. Есть три пакета (A1B1C1D1|A2B2C2D2|A3B3C3D3), которые должны нести одну и ту же информацию.

Но из картинки справа, видно, что второй символ (B1 и C1) они отличаются друг от друга, хотя должны были быть одинаковыми. То что они отличаются, говорит о том, что есть ошибка.

Необходимо найти ошибку с помощью голосования, каких символов больше, символов В или символов С? Явно символов В больше, чем символов С, соответственно принимаем решение, что передавался символ В, а символ С ошибочный.

Для исправления ошибок нужно, как минимум 3 пакета информации, для обнаружения, как минимум 2 пакета информации.

Параметры помехоустойчивого кодирования

Первый параметр, скорость кода R характеризует долю информационных («полезных») данных в сообщении и определяется выражением: R=k/n=k/m+k

- где n – количество символов закодированного сообщения (результата кодирования);

- m – количество проверочных символов, добавляемых при кодировании;

- k – количество информационных символов.

Параметры n и k часто приводят вместе с наименованием кода для его однозначной идентификации. Например, код Хэмминга (7,4) значит, что на вход кодера приходит 4 символа, на выходе 7 символов, Рида-Соломона (15, 11) и т.д.

Второй параметр, кратность обнаруживаемых ошибок – количество ошибочных символов, которые код может обнаружить.

Третий параметр, кратность исправляемых ошибок – количество ошибочных символов, которые код может исправить (обозначается буквой t).

Контроль чётности

Самый простой метод помехоустойчивого кодирования это добавление одного бита четности. Есть некое информационное сообщение, состоящее из 8 бит, добавим девятый бит.

Если нечетное количество единиц, добавляем 0.

1 0 1 0 0 1 0 0 | 0

Если четное количество единиц, добавляем 1.

1 1 0 1 0 1 0 0 | 1

Если принятый бит чётности не совпадает с рассчитанным битом чётности, то считается, что произошла ошибка.

1 1 0 0 0 1 0 0 | 1

Под кратностью понимается, всевозможные ошибки, которые можно обнаружить. В этом случае, кратность исправляемых ошибок 0, так как мы не можем исправить ошибки, а кратность обнаруживаемых 1.

Есть последовательность 0 и 1, и из этой последовательности составим прямоугольную матрицу размера 4 на 4. Затем для каждой строки и столбца посчитаем бит четности.

Прямоугольный код – код с контролем четности, позволяющий исправить одну ошибку:

И если в процессе передачи информации допустим ошибку (ошибка нолик вместо единицы, желтым цветом), начинаем делать проверку. Нашли ошибку во втором столбце, третьей строке по координатам. Чтобы исправить ошибку, просто инвертируем 1 в 0, тем самым ошибка исправляется.

Этот прямоугольный код исправляет все одно-битные ошибки, но не все двух-битные и трех-битные.

Рассчитаем скорость кода для:

- 1 1 0 0 0 1 0 0 | 1

Здесь R=8/9=0,88

- И для прямоугольного кода:

Здесь R=16/24=0,66 (картинка выше, двадцать пятую единичку (бит четности) не учитываем)

Более эффективный с точки зрения скорости является первый вариант, но зато мы не можем с помощью него исправлять ошибки, а с помощью прямоугольного кода можно. Сейчас на практике прямоугольный код не используется, но логика работы многих помехоустойчивых кодов основана именно на прямоугольном коде.

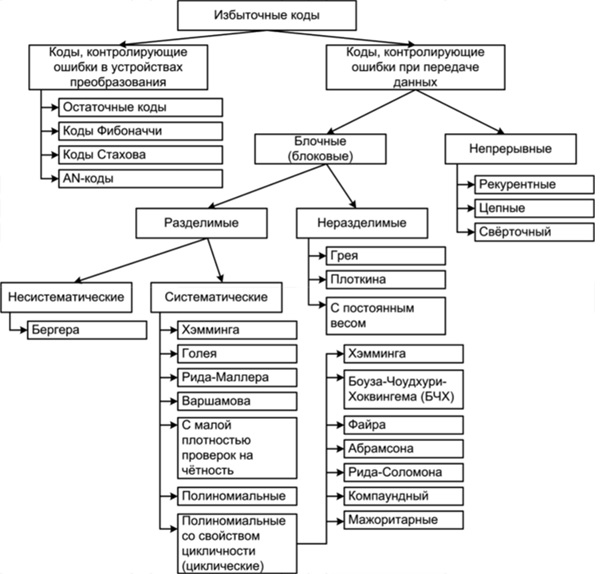

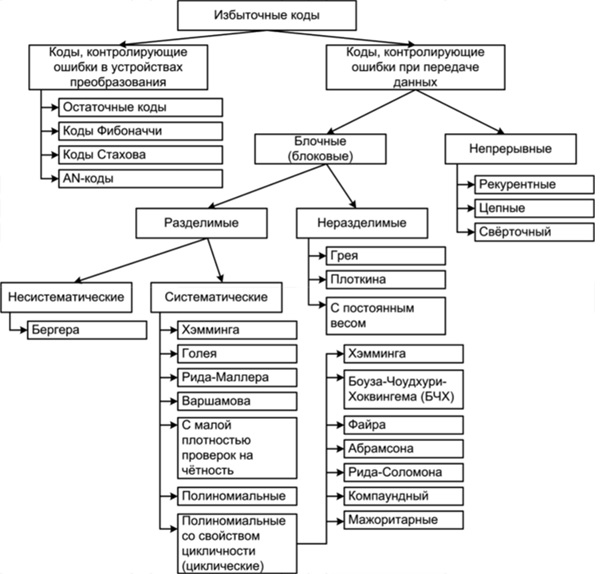

Классификация помехоустойчивых кодов

- Непрерывные — процесс кодирования и декодирования носит непрерывный характер. Сверточный код является частным случаем непрерывного кода. На вход кодера поступил один символ, соответственно, появилось несколько на выходе, т.е. на каждый входной символ формируется несколько выходных, так как добавляется избыточность.

- Блочные (Блоковые) — процесс кодирования и декодирования осуществляется по блокам. С точки зрения понимания работы, блочный код проще, разбиваем код на блоки и каждый блок кодируется в отдельности.

По используемому алфавиту:

- Двоичные. Оперируют битами.

- Не двоичные (код Рида-Соломона). Оперируют более размерными символами. Если изначально информация двоичная, нужно эти биты превратить в символы. Например, есть последовательность 110 110 010 100 и нужно их преобразовать из двоичных символов в не двоичные, берем группы по 3 бита — это будет один символ, 6, 6, 2, 4 — с этими не двоичными символами работают не двоичные помехоустойчивые коды.

Блочные коды делятся на

- Систематические — отдельно не измененные информационные символы, отдельно проверочные символы. Если на входе кодера присутствует блок из k символов, и в процессе кодирования сформировали еще какое-то количество проверочных символов и проверочные символы ставим рядом к информационным в конец или в начало. Выходной блок на выходе кодера будет состоять из информационных символов и проверочных.

- Несистематические — символы исходного сообщения в явном виде не присутствуют. На вход пришел блок k, на выходе получили блок размером n, блок на выходе кодера не будет содержать в себе исходных данных.

В случае систематических кодов, выходной блок в явном виде содержит в себе, то что пришло на вход, а в случае несистематического кода, глядя на выходной блок нельзя понять что было на входе.

Смотря на картинку выше, код 1 1 0 0 0 1 0 0 | 1 является систематическим, на вход поступило 8 бит, а на выходе кодера 9 бит, которые в явном виде содержат в себе 8 бит информационных и один проверочный.

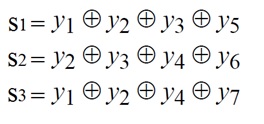

Код Хэмминга

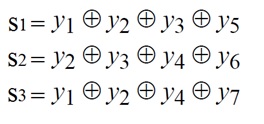

Код Хэмминга — наиболее известный из первых самоконтролирующихся и самокорректирующихся кодов. Позволяет устранить одну ошибку и находить двойную.

Код Хэмминга (7,4) — 4 бита на входе кодера и 7 на выходе, следовательно 3 проверочных бита. С 1 по 4 информационные биты, с 6 по 7 проверочные (см. табл. выше). Пятый проверочный бит y5, это сумма по модулю два 1-3 информационных бит. Сумма по модулю 2 это вычисление бита чётности.

Декодирование кода Хэмминга

Декодирование происходит через вычисление синдрома по выражениям:

Синдром это сложение бит по модулю два. Если синдром не нулевой, то исправление ошибки происходит по таблице декодирования:

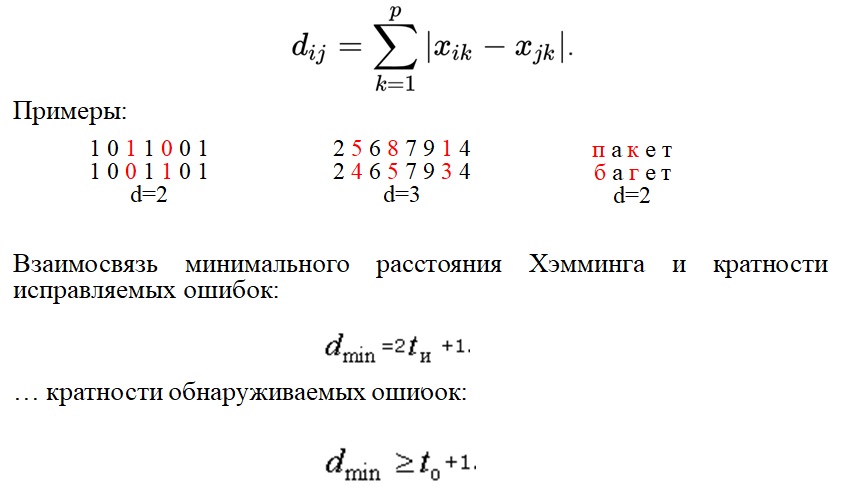

Расстояние Хэмминга

Расстояние Хэмминга — число позиций, в которых соответствующие символы двух кодовых слов одинаковой длины различны. Если рассматривать два кодовых слова, (пример на картинке ниже, 1 0 1 1 0 0 1 и 1 0 0 1 1 0 1) видно что они отличаются друг от друга на два символа, соответственно расстояние Хэмминга равно 2.

Кратность исправляемых ошибок и обнаруживаемых, связано минимальным расстоянием Хэмминга. Любой помехоустойчивый код добавляет избыточность с целью увеличить минимальное расстояние Хэмминга. Именно минимальное расстояние Хэмминга определяет помехоустойчивость.

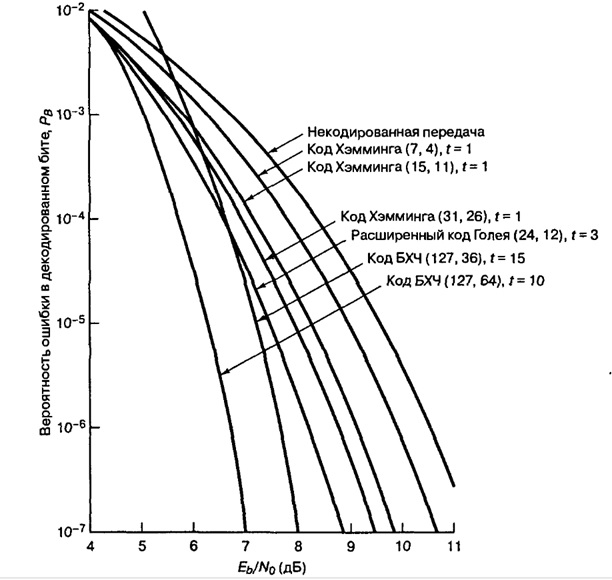

Помехоустойчивые коды

Современные коды более эффективны по сравнению с рассматриваемыми примерами. В таблице ниже приведены Коды Боуза-Чоудхури-Хоквингема (БЧХ)

Из таблицы видим, что там один класс кода БЧХ, но разные параметры n и k.

- n — количество символов на входе.

- k — количество символов на выходе.

- t — кратность исправляемых ошибок.

- Отношение k/n — скорость кода.

- G (энергетический выигрыш) — величина, показывающая на сколько можно уменьшить отношение сигнал/шум (Eb/No) для обеспечения заданной вероятности ошибки.

Несмотря на то, что скорость кода близка, количество исправляемых ошибок может быть разное. Количество исправляемых ошибок зависит от той избыточности, которую добавим и от размера блока. Чем больше блок, тем больше ошибок он исправляет, даже при той же самой избыточности.

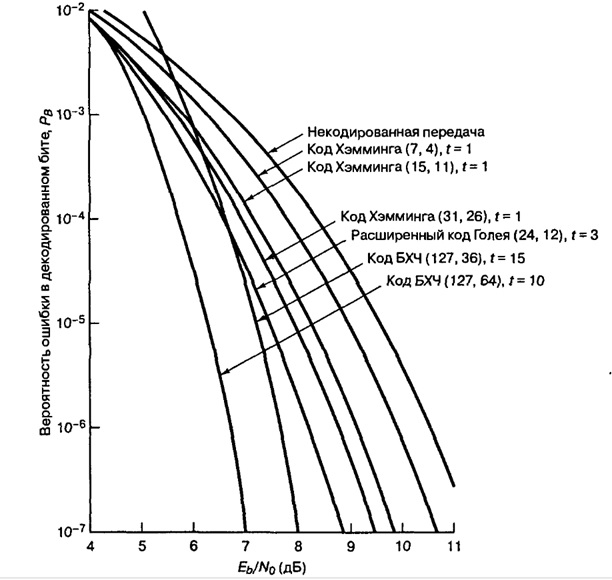

Пример: помехоустойчивые коды и двоичная фазовая манипуляция (2-ФМн). На графике зависимость отношения сигнал шум (Eb/No) от вероятности ошибки. За счет применения помехоустойчивых кодов улучшается помехоустойчивость.

Из графика видим, код Хэмминга (7,4) на сколько увеличилась помехоустойчивость? Всего на пол Дб это мало, если применить код БЧХ (127, 64) выиграем порядка 4 дБ, это хороший показатель.

Компромиссы при использовании помехоустойчивых кодов

Чем расплачиваемся за помехоустойчивые коды? Добавили избыточность, соответственно эту избыточность тоже нужно передавать. Нужно: увеличивать пропускную способность канала связи, либо увеличивать длительность передачи.

Компромисс:

- Достоверность vs полоса пропускания.

- Мощность vs полоса пропускания.

- Скорость передачи данных vs полоса пропускания

Необходимость чередования (перемежения)

Все помехоустойчивые коды могут исправлять только ограниченное количество ошибок t. Однако в реальных системах связи часто возникают ситуации сгруппированных ошибок, когда в течение непродолжительного времени количество ошибок превышает t.

Например, в канале связи шумов мало, все передается хорошо, ошибки возникают редко, но вдруг возникла импульсная помеха или замирания, которые повредили на некоторое время процесс передачи, и потерялся большой кусок информации. В среднем на блок приходится одна, две ошибки, а в нашем примере потерялся целый блок, включая информационные и проверочные биты. Сможет ли помехоустойчивый код исправить такую ошибку? Эта проблема решаема за счет перемежения.

Пример блочного перемежения:

На картинке, всего 5 блоков (с 1 по 25). Код работает исправляя ошибки в рамках одного блока (если в одном блоке 1 ошибка, код его исправит, а если две то нет). В канал связи отдается информация не последовательно, а в перемешку. На выходе кодера сформировались 5 блоков и эти 5 блоков будем отдавать не по очереди а в перемешку. Записали всё по строкам, но считывать будем, чтобы отправлять в канал связи, по столбцам. Информация в блоках перемешалась. В канале связи возникла ошибка и мы потеряли большой кусок. В процессе приема, мы опять составляем таблицу, записываем по столбцам, но считываем по строкам. За счет того, что мы перемешали большое количество блоков между собой, групповая ошибка равномерно распределится по блокам.

Коды Боуза — Чоудхури — Хоквингхема (БЧХ-коды) — в теории кодирования это широкий класс циклических кодов, применяемых для защиты информации от ошибок (см. Обнаружение и исправление ошибок). Отличается возможностью построения кода с заранее определенными корректирующими свойствами, а именно, минимальным кодовым расстоянием. Коды Рида — Соломона являются частным случаем БЧХ-кодов.

Содержание

- 1 Формальное описание

- 2 Построение

- 3 Примеры кодов

- 3.1 Примитивный 2-ичный (15,7,5) код

- 3.2 16-ричный (15,11,5) код (код Рида — Соломона)

- 4 Кодирование

- 5 Методы декодирования

- 5.1 Алгоритм Питерсона — Горенстейна — Цирлера (ПГЦ)

- 6 См. также

- 7 Литература

Формальное описание

БЧХ-код является циклическим кодом, который можно задать порождающим полиномом. Для его нахождения в случае БЧХ-кода необходимо заранее определить длину кода n (она не может быть произвольной) и требуемое минимальное расстояние  . Найти порождающий полином можно следующим образом.

. Найти порождающий полином можно следующим образом.

Пусть α — примитивный элемент поля GF(qm) (то есть  ), пусть β = αs, — элемент поля GF(qm) порядка

), пусть β = αs, — элемент поля GF(qm) порядка  . Тогда нормированный полином g(x) минимальной степени над полем GF(q), корнями которого являются d − 1 подряд идущих степеней

. Тогда нормированный полином g(x) минимальной степени над полем GF(q), корнями которого являются d − 1 подряд идущих степеней  элемента β для некоторого целого l0 (в том числе 0 и 1), является порождающим полиномом БЧХ-кода над полем GF(q) с длиной n и минимальный расстоянием

элемента β для некоторого целого l0 (в том числе 0 и 1), является порождающим полиномом БЧХ-кода над полем GF(q) с длиной n и минимальный расстоянием  .

.

Число проверочных символов r равно степени g(x), число информационных символов k = n − r, величина d называется конструктивным расстоянием БЧХ-кода. Если n = qm − 1, то код называется примитивным, иначе непримитивным.

Так же, как и для циклического кода, кодовый полином c(x) может быть получен из информационного полинома m(x), степени не больше k − 1, путем перемножения m(x) и g(x):

c(x) = m(x)g(x).

Построение

Для нахождения порождающего полинома необходимо выполнить несколько этапов:

- выбрать q, то есть поле GF(q), над которым будет построен код;

- выбрать длину n кода из условия n = (qm − 1) / s, где m,s — целые положительные числа;

- задать величину d конструктивного расстояния;

1) построить циклотомические классы элемента β = αs поля GF(qm) над полем GF(q), где α — примитивный элемент GF(qm);

2) поскольку каждому такому циклотомическому классу соответвует неприводимый полином над GF(q), корнями которого являются элементы этого и только этого класса, со степенью равной количеству элементов в классе, то выбрать  таким образом, чтобы суммарная длина циклотомических классов была минимальна

таким образом, чтобы суммарная длина циклотомических классов была минимальна

3) вычислить порождающий полином  , где fi(x) — полином, соответсвующий i-ому циклотомическому классу

, где fi(x) — полином, соответсвующий i-ому циклотомическому классу

Примеры кодов

Примитивный 2-ичный (15,7,5) код

Пусть q = 2, требуемая длина кода n = 24 − 1 = 15 и минимальное расстояние  . Возьмем α — примитивный элемент поля GF(16), и α,α2,α3,α4 — четыре подряд идущих степеней элемента α. Они принадлежат двум циклотомическим классам над полем GF(2), которым соответсвуют неприводимые полиномы f1(x) = x4 + x + 1 и f2(x) = x4 + x3 + x2 + x + 1. Тогда полином

. Возьмем α — примитивный элемент поля GF(16), и α,α2,α3,α4 — четыре подряд идущих степеней элемента α. Они принадлежат двум циклотомическим классам над полем GF(2), которым соответсвуют неприводимые полиномы f1(x) = x4 + x + 1 и f2(x) = x4 + x3 + x2 + x + 1. Тогда полином

g(x) = f1(x)f2(x) = x8 + x7 + x6 + x4 + 1

имеет в качестве корней элементы α,α2,α3,α4 и является порождающим полиномом БЧХ-кода с параметрами (15,7,5).

16-ричный (15,11,5) код (код Рида — Соломона)

Пусть n = q − 1 = 15 и α — примитивный элемент GF(16). Тогда

g(x) = (x − α)(x − α2)(x − α3)(x − α4) = x4 + α13x3 + α6x2 + α3x + α10

.

Каждому элементу поля GF(16) можно сопоставить 4 битам, поэтому одно кодовое слово эквивалентно 60=15*4 битам, таким образом набору из 44 бит ставится в соответствие набор из 60 бит. Можно сказать, что такой код работает с полубайтами информации.

Кодирование

Для кодирования кодами БЧХ применяются те же методы, что и для кодирования циклическими кодами.

Методы декодирования

Коды БЧХ являются циклическими кодами, поэтому к ним применимы все методы, используемые для декодирования циклических кодов. Однако существуют гораздо лучшие алгоритмы, разработанные именно для БЧХ-кодов.

Исторически первым методом декодирования был найден Питерсоном для двоичного случая (q = 2), затем Горенстейном и Цирлером для общего случая. Упрощение алгоритма было найдено Берлекэмпом, а затем усовершенствовано Месси (алгоритм Берлекэмпа — Месси). Существует отличный от этих методов декдирования — метод основанный на алгоритме Евклида.

Алгоритм Питерсона — Горенстейна — Цирлера (ПГЦ)

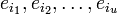

Пусть БЧХ код над полем GF(q) длины n и с конструктивным расстоянием d задается порождающим полиномом g(x), который имеет среди своих корней элементы  ,

,  — целое число (например 0 или 1). Тогда каждое кодовое слово обладает тем свойством, что

— целое число (например 0 или 1). Тогда каждое кодовое слово обладает тем свойством, что  . Принятое слово r(x) можно записать как r(x) = c(x) + e(x), где e(x) — полином ошибок. Пусть произошло

. Принятое слово r(x) можно записать как r(x) = c(x) + e(x), где e(x) — полином ошибок. Пусть произошло  ошибок на позициях

ошибок на позициях  (t максимальное число исправляемых ошибок), значит

(t максимальное число исправляемых ошибок), значит  , а

, а  — величины ошибок.

— величины ошибок.

Можно составить j-ый синдром Sj принятого слова r(x):

.

.

Задача состоит в нахождений числа ошибок u, их позиций  и их значений

и их значений  при известных синдромах Sj.

при известных синдромах Sj.

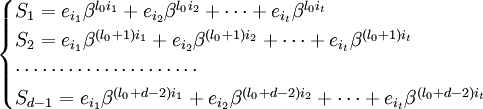

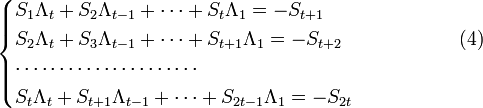

Предположим, для начала, что u в точности равно t. Запишем (1) в виде системы нелинейных(!) уравнений в явном виде:

Обозначим через  локатор k-ой ошибки, а через

локатор k-ой ошибки, а через  величину ошибки,

величину ошибки,  . При этом все Xk различны, так как порядок элемента β равен n, и поэтому при известном Xk можно определить ik как ik = logβXk.

. При этом все Xk различны, так как порядок элемента β равен n, и поэтому при известном Xk можно определить ik как ik = logβXk.

Составим полином локаторов ошибок:

Корнями этого полинома являются элементы, обратные локаторам ошибок. Помножим обе части этого полинома на  . Полученное равенство будет справедливо для

. Полученное равенство будет справедливо для  :

:

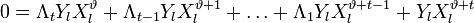

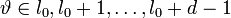

Положим  и подставим в (3). Получится равенство, справедливое для каждого

и подставим в (3). Получится равенство, справедливое для каждого  и при всех

и при всех  :

:

Таким образом для каждого l можно записать свое равенство. Если их просуммировать по l, то получиться равенство, справедливое для каждого  :

:

.

.

.

Учитывая (2) и то, что  (то есть

(то есть  меняется в тех же пределах, что и ранее) получаем систему линейных уравнений:

меняется в тех же пределах, что и ранее) получаем систему линейных уравнений:

.

Или в матричной форме

,

где

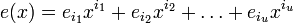

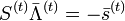

![S^{(t)}={ left[ begin{matrix} S_1 &amp; S_2 &amp; dots &amp; S_t S_2 &amp; S_3 &amp; dots &amp; S_{t+1} cdots &amp; cdots &amp; cdots &amp; S_t &amp; S_{t+1} &amp; dots &amp; S_{2t-1} end{matrix} right] }, quad quad quad quad quadquad(5)](https://dic.academic.ru/pictures/wiki/files/99/cb1fb0775da4988ff94bb8f82afbb614.png)

![barLambda^{(t)} = { left[ begin{matrix} Lambda_t Lambda_{t-1} cdots Lambda_1 end{matrix} right] }, quad quad bar s^{(t)} { left[ begin{matrix} S_{t+1} S_{t+2} cdots S_{2t} end{matrix} right] }](https://dic.academic.ru/pictures/wiki/files/102/fb3abb36e14beb74ecaab8e8af0df01e.png)

Если число ошибок и в самом деле равно t, то система (4) разрешима, и можно найти значения коэффициентов  . Если же число u < t, то определитель матрицы S(t) системы (4) будет равен 0. Это есть признак того, что количество ошибок меньше t. Поэтому необходимо составить систему (4), предполагая число ошибок равным t − 1. Высчитать определитель новой матрицы S(t − 1) и т. д., до тех пор, пока не установим истинное число ошибок.

. Если же число u < t, то определитель матрицы S(t) системы (4) будет равен 0. Это есть признак того, что количество ошибок меньше t. Поэтому необходимо составить систему (4), предполагая число ошибок равным t − 1. Высчитать определитель новой матрицы S(t − 1) и т. д., до тех пор, пока не установим истинное число ошибок.

После этого можно решить систему (4) и получить коэффициенты полинома локаторов ошибок. Его корни (элементы, обратные локаторам ошибок) можно найти простым перебором по всем элементам поля GF(qm). К ним найти элементы, обратные по умножению, — это локаторы ошибок  . По локаторам можно найти позиции ошибок (ik = logβXk), а значения Yk ошибок из системы (2), приняв t = u. Декодирование завершено.

. По локаторам можно найти позиции ошибок (ik = logβXk), а значения Yk ошибок из системы (2), приняв t = u. Декодирование завершено.

См. также

- Обнаружение и исправление ошибок

- Конечное поле

- Многочлен над конечным полем

- Матрица Вандермонда

- Линейный код

- Циклический код

- Код Рида — Соломона

Литература

- Блейхут Р. Теория и практика кодов, контролирующих ошибки = Theory and practice of error control codes. — М.: Мир, 1986. — С. 576.

- Питерсон У., Уэлдон Э. Коды, исправляющие ошибки. — М.: Мир, 1976. — С. 596.

Wikimedia Foundation.

2010.

3.1. КОДЫ БЧХ, ИСПРАВЛЯЮЩИЕ ДВЕ ОШИБКИ (I)

Известно из гл. 1, что коды Хэмминга исправляют одиночные ошибки. В этой главе будут введены коды, которые в определенном смысле обобщают их на случай  ошибок и называются кодами Боуза-Чоудхури-Хоквингема (или, кратко, кодами БЧХ). в этой же главе мы введем одну из центральных тем теории кодирования, а именно теорию конечных полей.

ошибок и называются кодами Боуза-Чоудхури-Хоквингема (или, кратко, кодами БЧХ). в этой же главе мы введем одну из центральных тем теории кодирования, а именно теорию конечных полей.

Попытаемся вначале найти обобщение кодов Хэмминга, позволяющее исправлять две ошибки.

Двоичный код Хэмминга длины  должен иметь

должен иметь  проверочных символов, чтобы исправлять одну ошибку. Естественное предположение состоит в том, что для исправления двух ошибок необходимо

проверочных символов, чтобы исправлять одну ошибку. Естественное предположение состоит в том, что для исправления двух ошибок необходимо  проверочных символов. Итак, попытаемся построить проверочную матрицу

проверочных символов. Итак, попытаемся построить проверочную матрицу  кода, исправляющего две ошибки, добавляя еще

кода, исправляющего две ошибки, добавляя еще  строк к проверочной матрице

строк к проверочной матрице  кода Хэмминга.

кода Хэмминга.

В качестве примера возьмем  Тогда матрица

Тогда матрица  имеет своими столбцами все возможные ненулевые

имеет своими столбцами все возможные ненулевые  -векторы:

-векторы:

что мы сокращенно обозначим как

где через число  обозначен соответствующий ему двоичный 4-вектор. Мы собираемся добавить к

обозначен соответствующий ему двоичный 4-вектор. Мы собираемся добавить к  еще 4 строки, например таким способом

еще 4 строки, например таким способом

где значением функции  также является вектор длины 4 из нулей и единиц. Поэтому

также является вектор длины 4 из нулей и единиц. Поэтому  столбец матрицы

столбец матрицы

представляет собой вектор-столбец длины 8.

Как выбрать функцию  Предположим, что произошли две ошибки — на позициях

Предположим, что произошли две ошибки — на позициях  Тогда (по теореме 4 гл. 1) синдром равен

Тогда (по теореме 4 гл. 1) синдром равен

Необходимо выбрать  так, чтобы декодер по

так, чтобы декодер по  мог найти

мог найти  т. е. чтобы он мог одновременно решить уравнения

т. е. чтобы он мог одновременно решить уравнения

относительно  при заданных

при заданных  При этом все эти элементы

При этом все эти элементы  являются векторами длины

являются векторами длины

Для того чтобы решить эти уравнения, нам хотелось бы уметь складывать, вычитать, умножать и делить эти  -векторы. Другими словами, мы хотим, чтобы эти

-векторы. Другими словами, мы хотим, чтобы эти  -векторы образовывали поле. Вначале опишем построение этого поля, а затем вернемся к проблеме построения кодов, исправляющих две ошибки.

-векторы образовывали поле. Вначале опишем построение этого поля, а затем вернемся к проблеме построения кодов, исправляющих две ошибки.

Определение. Поле — это множество элементов в котором определены операции сложения, вычитания, умножения и деления (за исключением деления на 0, которое не определено). Сложение и умножение должны удовлетворять коммутативному, ассоциативному и дистрибутивному законам: для любых элементов  у в этом поле должны выполняться соотношения а

у в этом поле должны выполняться соотношения а

кроме того, должны существовать элементы 0, 1 (и для любого а)  такие, что

такие, что

Конечное поле содержит конечное число элементов, и это число называется порядком поля.

Конечные поля называются полями Галуа по имени их первого исследователя Эвариста Галуа.

Содержание

Раздел создан при поддержке компании RAIDIX

Для понимания материалов настоящего раздела крайне желательно ознакомиться с разделом Циклические коды.

Коды Боуза-Чоудхури-Хоквингема

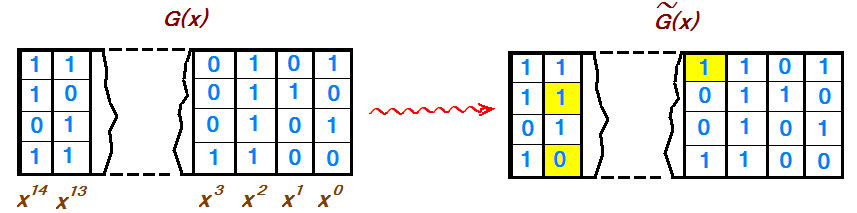

Идея

Для ее пояснения обратимся к материалам

☞

ПУНКТА и рассмотрим циклические коды в $ mathbb Z^n $. Принадлежность кодового слова $ (b_0,b_1,dots,b_{n-1}) $ циклическому коду $ C_{} $, порождаемому полиномом

$$ g(x)=a_0+a_1x+a_2x^2+dots+a_{r}x^{r}, (r<n,a_{r}ne 0) , ,$$

равносильна тому, что полином

$$ G(x)=b_0+b_1x+b_2x^2+dots+b_{n-1}x^{n-1} $$

делится на $ g_{}(x) $. Предположим теперь, что при передаче по зашумленному каналу связи кодовый полином (кодовое слово) исказился и на выходе мы получили полином

$$ tilde G(x)= G(x)+E_jx^j+E_kx^k quad npu quad {j,k} subset {0,1,2,dots,n-1}, j < k, {E_j,E_k} subset mathbb Z .$$

В

☞

ПУНКТЕ предлагался метод нахождения ошибок в случае, когда они соседствуют, т.е. $ k=j+1 $. Фактически, задача в такой постановке оказывалась задачей с тремя неизвестными: требовалось найти место ошибки $ j_{} $ и величины ошибок $ E_j,E_{j+1} $. Теперь мы рассмотреть общий случай, когда неизвестными являются четыре величины $ j,k,E_j,E_k $. Интуитивно понятно, что для нахождения этих четырех неизвестных требуется, по меньшей мере, такое же количество условий. По аналогии с рассмотренным в

☞

ПУНКТЕ подходом, будем пытаться найти эти условия виде $ tilde G(lambda_{ell})=0 $, где $ lambda_{ell} $ — корень порождающего код полинома $ g_{}(x) $, т.е. $ g_{}(lambda_{ell})=0 $ и $ G(lambda_{ell})=0 $. Если $ lambda_1,lambda_2,lambda_3,lambda_4 $ — различные корни полинома $ g_{}(x) $, то подстановка их в «зашумленный» полином $ tilde G(x) $ приведет к системе уравнений

$$ E_jlambda_1^j+E_klambda_1^k= tilde G(lambda_1), E_jlambda_2^j+E_klambda_2^k= tilde G(lambda_2), E_jlambda_3^j+E_klambda_3^k= tilde G(lambda_3), E_jlambda_4^j+E_klambda_4^k= tilde G(lambda_4) , $$

линейной по неизвестным $ E_j $ и $ E_k $, но нелинейной по значениям индексов $ j_{} $ и $ k_{} $. Эту систему требуется решить в целых числах. Можно попробовать осуществить поиск решений перебором вариантов (например, положив гипотезой что величины ошибок $ E_j $ и $ E_k $ невелики); однако этот подход не кажется конструктивным если оценить число потенциально возможных комбинаций в зависимости от $ n_{} $.

Допустим теперь, что порождающий $ n_{} $-код полином $ g_{}(x) $ удается подобрать так, чтобы его корнями оказались бы величины

$$ lambda_1=varepsilon_1, lambda_2=varepsilon_1^2, lambda_3=varepsilon_1^3, lambda_4=varepsilon_1^4 quad npu quad varepsilon_1=cos frac{2pi}{n}+mathbf i sin frac{2pi}{n} $$

— корне степени n из единицы. Посмотрим как можно использовать эту возможность для решения задачи исправления ошибок. Подставим корни в предыдущую систему, воспользовавшись равенствами

$$ varepsilon_1^j = varepsilon_j=cos frac{2pi,j}{n}+mathbf i sin frac{2pi , j}{n} , varepsilon_1^k=varepsilon_k= cos frac{2pi,k}{n}+mathbf i sin frac{2pi,k}{n} , $$

получим «систему ошибок»1)

$$

left{ begin{array}{rrl}

E_j varepsilon_j & + E_k varepsilon_k & = tilde G(varepsilon_1),

E_j varepsilon_j^2 & + E_k varepsilon_k^2 & = tilde G(varepsilon_1^2),

E_j varepsilon_j^3& + E_k varepsilon_k^3 & = tilde G(varepsilon_1^3),

E_j varepsilon_j^4 & + E_k varepsilon_k^4 & = tilde G(varepsilon_1^4).

end{array}

right.

$$

Попробуем на основе этих равенств сконструировать новое — квадратное:

$$ sigma_2+sigma_1x+sigma_0x^2=0 , $$

которому должны удовлетворять обе величины $ varepsilon_j $ и $ varepsilon_k $. С этой целью умножим первое из этих разыскиваемых уравнений на $ E_j varepsilon_j $, второе — на $ E_k varepsilon_k $

$$

left{ begin{array}{rl|lc|lc}

sigma_2+sigma_1varepsilon_j+sigma_0varepsilon_j^2&=0, & times E_j varepsilon_j & & times E_j varepsilon_j^2 &

& & & + & & +

sigma_2+sigma_1varepsilon_k+sigma_0varepsilon_k^2&=0 & times E_k varepsilon_k & & times E_k varepsilon_k^2. &

end{array}

right.

$$

и сложим:

$$ sigma_2 (E_j varepsilon_j +E_k varepsilon_k)+sigma_1(E_j varepsilon_j^2 +E_k varepsilon_k^2)+sigma_0(E_j varepsilon_j^3 +E_k varepsilon_k^3)=0 ;

$$

аналогичным образом, домножим первое из равенств на $ E_j varepsilon_j^2 $, второе — на $ E_k varepsilon_k^2 $ и сложим:

$$ sigma_2 (E_j varepsilon_j^2 +E_k varepsilon_k^2)+sigma_1(E_j varepsilon_j^3 +E_k varepsilon_k^3)+sigma_0(E_j varepsilon_j^4 +E_k varepsilon_k^4)=0 .

$$

Обратим теперь внимание на то, что все величины, стоящие в полученных формулах в круглых скобках, нам известны из приведенной выше системы:

$$

left{ begin{array}{rl}

sigma_2tilde G(varepsilon_1)+sigma_1tilde G(varepsilon_1^2)+sigma_0tilde G(varepsilon_1^3)&=0,

sigma_2tilde G(varepsilon_1^2)+sigma_1tilde G(varepsilon_1^3)+sigma_0tilde G(varepsilon_1^4)&=0.

end{array}

right.

$$

Эта система линейна относительно неизвестных коэффициентов $ sigma_0, sigma_1,sigma_2 $. Возникает вопрос о ее разрешимости.

Т

Теорема.

Пусть порождающий код полином обладает корнями $ varepsilon_1,varepsilon_1^2,varepsilon_1^3,varepsilon_1^4 $. Если при передаче кодового полинома

$$ G(x)=b_0+b_1x+b_2x^2+dots+b_{n-1}x^{n-1} $$

произошли ровно две ошибки в $ j_{} $-м и $ k_{} $-м коэффициентах, и на выходе канала связи получен полином $ tilde G(x) $, то корни степени $ n_{} $ из единицы, обозначенные $ varepsilon_j $ и $ varepsilon_k $, удовлетворяют «уравнению ошибочных позиций»2)

$$

left| begin{array}{ccc}

tilde G(varepsilon_1) & tilde G(varepsilon_1^2) & tilde G(varepsilon_1^3)

tilde G(varepsilon_1^2) & tilde G(varepsilon_1^3) & tilde G(varepsilon_1^4)

1 & x & x^2

end{array}

right|=0 .

$$

Доказательство. Фактически к двум линейным уравнениям мы приписываем $ sigma_2+sigma_1x+sigma_0x^2=0 $, и к получившейся линейной однородной системе относительно неизвестных $ sigma_2,sigma_1,sigma_0 $ применяем критерий существования нетривиального решения: определитель этой системы должен быть равен нулю.

♦

В следующем пункте я часто буду употреблять подобные детерминантные представления, нетрадиционные для теории кодирования. В последней обычно разыскивают полином ошибочных позиций в виде нормализованного полинома — со старшим коэффициентом равным $ 1_{} $.

Разрешив уравнение ошибочных позиций, мы определим величины $ varepsilon_j $ и $ varepsilon_k $, и, следовательно, сможем восстановить значения соответствующих индексов $ {j,k} subset {0,1,2,dots,n-1} $, т.е. номеров коэффициентов полинома, в которых произошли ошибки. Величины же $ E_j $ и $ E_k $ этих ошибок восстанавливаются из первых двух уравнений системы ошибок:

$$

left{ begin{array}{rrl}

E_j varepsilon_j & + E_k varepsilon_k & = tilde G(varepsilon_1),

E_j varepsilon_j^2 & + E_k varepsilon_k^2 & = tilde G(varepsilon_1^2)

end{array}

right.

$$

Впрочем, как правило, величины $ E_j $ и $ E_k $ можно установить только из первого уравнения — если воспользоваться условием их вещественности.

Остался открытым вопрос о возможности выбора порождающего циклический код полинома $ g_{}(x) $, имеющего одновременно корнями $ varepsilon_1, varepsilon_1^2,varepsilon_1^3,varepsilon_1^4 $. При этом полином $ g_{}(x) $ должен иметь целочисленные коэффициенты — иначе мы не сможем организовать выбор кодовых слов в пространстве $ mathbb Z^n $. По аналогии с подходом

☞

ПУНКТА можно попробовать выбрать полином $ g_{}(x) $ как произведение полиномов деления круга $ X_j(x) $. Действительно, при любом $ nin mathbb N $ полином $ X_n(x) $ будет иметь корнем $ varepsilon_1 $, равно как и любой другой первообразный корень степени $ n_{} $. Тогда при $ nge 5 $ и $ n_{} $ — простом, все степени $ {varepsilon_1^j}_{j=1}^{n-1} $ будут первообразными корнями степени $ n_{} $, и, следовательно, будут корнями полинома $ X_n(x) $. В этом случае можно было бы взять $ g(x)equiv X_n(x) $, однако, хотя с формальной точки зрения это и допустимо, тем не менее, с точки зрения практической пользы такой вариант бессмыслен: при любом способе кодирования в циклическом коде размерность кодового пространства $ mathbb U $ становится равной $ 1_{} $, т.е. в $ n_{} $-кодовом слове остается единственный свободный разряд, который можно использовать в качестве информационного.

Итак, число $ nge 5 $ должно быть составным. Пусть $ n_{} $— нечетно. Тогда (см.

☞

ЗДЕСЬ) величины $ varepsilon_1, varepsilon_1^2,varepsilon_1^4 $ будут все первообразными корнями и, следовательно,

корнями полинома $ X_n(x) $. Если $ n_{} $ не делится на $ 3_{} $, то и $ varepsilon_1^3 $ будет первообразным корнем, т.е. корнем $ X_n(x) $. Обобщим эти рассуждения: если $ n_{}ge 5 $ — составное и $ operatorname{HOD}(n,6)=1 $, то можно взять $ g(x)equiv X_n(x) $. Если $ operatorname{HOD}(n,6)>1 $, то полином $ g_{}(x) $ можно построить в виде произведения полиномов $ X_j(x) $. Так,

при $ operatorname{HOD}(n,6)=2 $ можно взять $ g(x)equiv X_n(x)X_{n/2}(x) $ в случае когда $ n_{} $ не делится на $ 4_{} $ и $ g(x)equiv X_n(x)X_{n/2}(x)X_{n/4}(x) $ в случае когда $ n_{} $ делится на $ 4_{} $

П

Пример. Пусть $ n=15 $ и порождающий циклический код полином выбран в виде

$$ g(x)equiv X_5(x)X_{15}(x)equiv (1+x+x^2+x^3+x^4)(1-x+x^3-x^4+x^5-x^7+x^8) equiv $$

$$ equiv 1+x^3+x^6+x^9+x^{12} . $$

Пусть при передаче некоторого кодового полинома $ G_{}(x) $ на выходе канала получен полином

$$ tilde G(x)=-1+5,x+2,x^2-x^3+3,x^4+2,x^5-x^6+5,x^7+2,x^8-x^9+5,x^{10}+2,x^{11}-x^{12}+2,x^{13}+2,x^{14} . $$

Требуется восстановить кодовый полином $ G_{}(x) $, основываясь на гипотезе, что при передаче произошло ровно две ошибки.

Решение. Порождающий код полином $ g_{}(x) $ удовлетворяет условиям теоремы: его корнями являются

величины $ varepsilon_1, varepsilon_1^2,varepsilon_1^3,varepsilon_1^4 $ при

$$ varepsilon_1=cos frac{2pi}{15}+mathbf i sin frac{2pi}{15} approx 0.913545+0.406736, mathbf i . $$

Вычисляем $ tilde G(varepsilon_1) approx -1.798335+0.240391 , mathbf i $. Поскольку $ tilde G(varepsilon_1) ne 0 $, то заключаем, что хотя бы одна ошибка при передаче по каналу произошла. Вычисляем дополнительно $ tilde G(varepsilon_1^2), tilde G(varepsilon_1^3), tilde G(varepsilon_1^4) $ и составляем уравнение ошибочных позиций из теоремы:

$$

left| begin{array}{rrr}

-1.798335+0.240391 , mathbf i & 2.269881+3.399389 , mathbf i & 1.809017+3.665469 , mathbf i

2.269881+3.399389 , mathbf i & 1.809017+3.665469 , mathbf i & 1.107352-1.437208 , mathbf i

1 & x & x^2

end{array}

right|=0

$$

или

$$

(17.562306-12.759762, mathbf i) +(-6.708203964+11.618950, mathbf i)x+(2.269125-21.589284, mathbf i)x^2=0 .

$$

Решаем его и находим

$$ mu_1 approx -0.104528+0.994522, mathbf i, mu_2approx 0.669131-0.743145, mathbf i . $$

Если при передаче по каналу произошли — как утверждается в условии — ровно две ошибки, то получившиеся значения должны быть корнями $ 15 $-й степени из единицы. Это немедленно проверяется. Остается выяснить каким значениям показателей $ varepsilon_j $ и $ varepsilon_k $ соответствуют эти числа.

$$ 15 arccos(-0.104528)/(2pi) approx 4 quad mbox{ и } quad 0.994522>0 quad Rightarrow j=4 . $$

$$ 15 arccos(0.669131)/(2pi) approx 2 quad mbox{ и } quad -0.743145<0 quad Rightarrow k=15-2=13 . $$

Итак, полином $ tilde G(x) $ имеет ошибочные коэффициенты при $ x^{4} $ и $ x^{13} $. Для нахождения величин этих ошибок имеем уравнение

$$ E_4 mu_1 + E_{13} mu_2 = tilde G(varepsilon_1) quad iff quad

left{ begin{array}{rrr}

-0.104528 E_4 &+0.669131 E_{13} & = -1.798335,

0.994522 E_4 &-0.743145 E_{13} & = 0.240391.

end{array} right. $$

Откуда получаем $ E_4approx -1.999997, E_{13} approx -2.999997 $. Заключаем, что $ G(x)equiv tilde G(x) +2,x^4+3,x^{13} $.

Теперь проверим насколько «устойчив» алгоритм к истинному количеству ошибок. Допустим, что вместо предполагаемых двух ошибок произошла одна и на выходе канала получен полином $ tilde G(x)equiv G(x)-4,x^7 $. Уравнение ошибочных позиций из теоремы

$$

left| begin{array}{rrr}

3.912590-0.831647 , mathbf i & -3.654182+1.626946 , mathbf i & 3.236068-2.351141 , mathbf i

-3.654182+1.626946 , mathbf i & 3.236068-2.351141 , mathbf i & -2.676522+2.972579 , mathbf i

1 & x & x^2

end{array}

right|=0

$$